La inteligencia artificial como nueva interfaz del conocimiento. La IA contemporánea se presenta cada vez más como una interfaz directa entre la persona y la información: una herramienta capaz de responder, ordenar, generar y acompañar procesos de aprendizaje, trabajo y creación. © GoldenDayz.

Introducción general: una revolución silenciosa y profunda

La inteligencia artificial se ha convertido en uno de los grandes temas de nuestro tiempo. Durante décadas fue una promesa lejana, asociada a laboratorios de investigación, películas de ciencia ficción, robots imaginarios o sistemas informáticos muy especializados. Sin embargo, en pocos años ha pasado a formar parte de la vida cotidiana de millones de personas. Hoy se utiliza para escribir, traducir, buscar información, generar imágenes, analizar datos, programar, organizar tareas, atender clientes, estudiar, crear contenidos o resolver problemas. Lo que antes parecía una tecnología reservada a expertos ha empezado a entrar en el escritorio, el móvil, la empresa, la escuela, la universidad y la vida diaria.

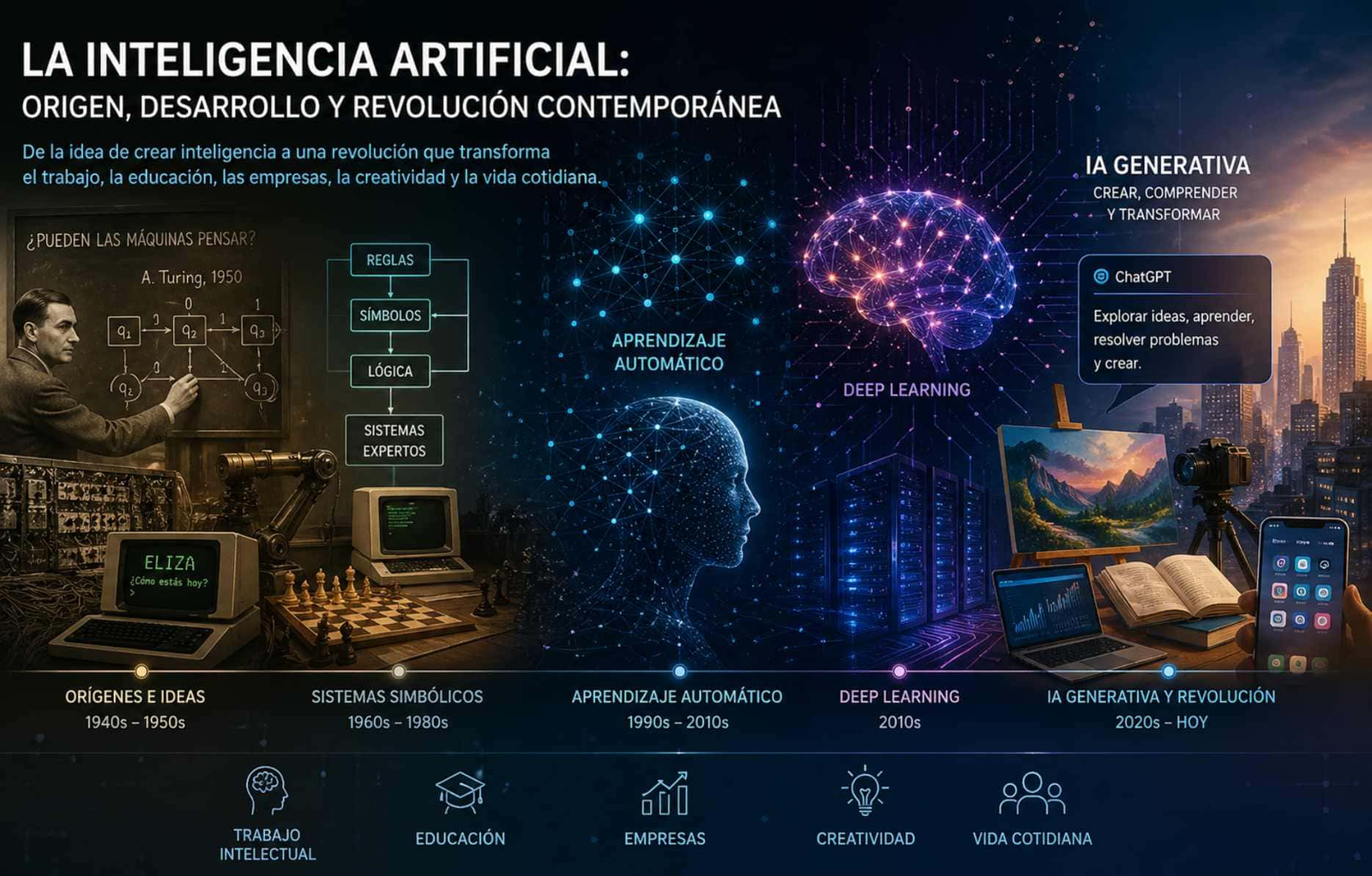

Esta transformación no ha llegado de golpe, aunque muchas veces lo parezca. La inteligencia artificial tiene una larga historia detrás. Nació como una pregunta filosófica y técnica: ¿puede una máquina realizar tareas que asociamos a la inteligencia humana? Esa pregunta, que durante mucho tiempo pareció casi abstracta, fue tomando forma con el desarrollo de la informática, la lógica matemática, los primeros ordenadores, los sistemas expertos, el aprendizaje automático, las redes neuronales y, más recientemente, la inteligencia artificial generativa. Cada etapa ha supuesto un avance, una ilusión, una dificultad y una nueva manera de entender la relación entre las personas y las máquinas.

Lo verdaderamente novedoso del momento actual es que la inteligencia artificial ya no se percibe solo como una herramienta técnica. Se ha convertido en un fenómeno cultural. No afecta únicamente a ingenieros, programadores o empresas tecnológicas, sino a escritores, profesores, estudiantes, diseñadores, médicos, periodistas, investigadores, artistas, trabajadores administrativos y usuarios comunes. Una persona puede mantener una conversación con un sistema artificial, pedirle una explicación, solicitar un esquema, corregir un texto, generar una imagen o recibir ayuda para ordenar una idea. Esa facilidad de acceso ha cambiado la percepción pública de la IA. Ya no hablamos solo de máquinas que calculan, sino de sistemas que parecen colaborar en tareas propias del pensamiento, el lenguaje y la creatividad.

Por eso la inteligencia artificial despierta tanta fascinación como inquietud. Fascina porque amplía capacidades. Permite ahorrar tiempo, explorar ideas, automatizar procesos, acceder a explicaciones personalizadas y crear materiales que antes requerían herramientas complejas. Pero también inquieta porque plantea preguntas profundas: qué ocurrirá con determinados trabajos, cómo se protegerán los datos personales, quién será responsable de los errores, cómo se evitarán los sesgos, qué pasará con la autoría, cómo distinguir una imagen real de una generada, o hasta qué punto podemos confiar en respuestas producidas por sistemas que no comprenden el mundo como lo hace una persona.

Esta entrada quiere situar la inteligencia artificial dentro de un marco amplio, histórico y divulgativo. No se trata solo de explicar una tecnología de moda, sino de comprender un proceso largo que une ciencia, cultura, economía, lenguaje y sociedad. Para ello conviene empezar desde el principio: qué entendemos por inteligencia artificial, de dónde viene el sueño de fabricar máquinas inteligentes, cómo evolucionaron los primeros sistemas basados en reglas, por qué llegaron momentos de desencanto, qué cambió con el aprendizaje automático y por qué la IA generativa ha supuesto un salto tan visible para el público general.

También es necesario mirar sus efectos. La inteligencia artificial está modificando la manera en que trabajamos, aprendemos, escribimos, investigamos y producimos imágenes o textos. Puede convertirse en una gran aliada del conocimiento, pero no sustituye el criterio humano. Una máquina puede ayudar a ordenar ideas, detectar patrones o producir una respuesta coherente, pero sigue siendo la persona quien debe decidir, revisar, interpretar, contextualizar y asumir la responsabilidad final. La IA puede ser una herramienta poderosa, pero su valor depende del uso que hagamos de ella.

En el fondo, hablar de inteligencia artificial es hablar también de nosotros mismos. Cada avance técnico nos obliga a preguntarnos qué entendemos por inteligencia, por creatividad, por aprendizaje y por trabajo humano. Las máquinas no son personas, pero al imitar algunas de nuestras capacidades nos devuelven una imagen nueva de lo que somos. La inteligencia artificial no solo abre una frontera tecnológica; abre una frontera cultural. Nos obliga a pensar cómo queremos vivir con estas herramientas, qué límites debemos establecer y qué papel queremos reservar al juicio, la sensibilidad y la responsabilidad humanas.

Por eso esta primera entrada estará dedicada al origen, la evolución y el significado general de la inteligencia artificial. Después, en una segunda entrada, podremos centrarnos de manera más concreta en ChatGPT, como una de las herramientas que mejor representan esta nueva etapa conversacional y generativa. Antes de entrar en ese caso particular, conviene entender el camino más amplio: cómo hemos llegado hasta aquí, qué fuerzas han hecho posible esta revolución y por qué la inteligencia artificial se ha convertido en una de las nuevas fronteras del conocimiento contemporáneo.

«La inteligencia artificial: origen, evolución y nueva frontera del conocimiento».

1. Introducción general: una revolución silenciosa y profunda

1.1. La inteligencia artificial como uno de los grandes cambios culturales del siglo XXI.

1.2. De la herramienta técnica al fenómeno social.

1.3. Por qué la IA afecta al conocimiento, al trabajo y a la vida cotidiana.

1.4. Entre fascinación, utilidad, incertidumbre y responsabilidad.

2. Qué entendemos por inteligencia artificial

2.1. La idea básica: máquinas capaces de realizar tareas asociadas a la inteligencia humana.

2.2. Inteligencia, cálculo, lenguaje, aprendizaje y decisión.

2.3. Diferencia entre automatización, informática tradicional e inteligencia artificial.

2.4. Por qué la IA no “piensa” como una persona, aunque pueda simular tareas inteligentes.

3. El viejo sueño de crear inteligencia artificial

3.1. Autómatas, mitos y máquinas imaginadas antes de la informática.

3.2. La modernidad técnica: lógica, cálculo y primeros computadores.

3.3. Alan Turing y la pregunta por la inteligencia de las máquinas.

3.4. El nacimiento formal de la inteligencia artificial en el siglo XX.

4. Primera etapa: la inteligencia artificial simbólica

4.1. Sistemas basados en reglas, símbolos y razonamiento lógico.

4.2. La idea de programar el conocimiento humano.

4.3. Los sistemas expertos y la promesa de automatizar decisiones complejas.

4.4. Límites de la IA simbólica: rigidez, falta de contexto y dificultad para aprender.

5. Los inviernos de la inteligencia artificial

5.1. Expectativas excesivas y resultados insuficientes.

5.2. La pérdida de financiación y confianza en algunas etapas.

5.3. Por qué la IA avanzó de forma irregular y no lineal.

5.4. La importancia de los datos, la potencia de cálculo y los nuevos métodos.

6. Segunda etapa: aprendizaje automático y redes neuronales

6.1. De programar reglas a entrenar modelos con datos.

6.2. Qué significa que una máquina “aprenda” patrones.

6.3. El papel de las redes neuronales artificiales.

6.4. Reconocimiento de imágenes, traducción automática, recomendadores y predicción.

7. El salto del aprendizaje profundo

7.1. Qué cambió con el deep learning.

7.2. Grandes bases de datos, procesadores potentes y modelos más complejos.

7.3. La IA en buscadores, redes sociales, medicina, transporte y consumo digital.

7.4. Ventajas y riesgos de una inteligencia basada en patrones masivos.

8. La aparición de la inteligencia artificial generativa

8.1. De analizar datos a producir textos, imágenes, música, código y respuestas.

8.2. Qué significa “generar” contenido nuevo a partir de patrones aprendidos.

8.3. Modelos de lenguaje, imágenes sintéticas y creación asistida.

8.4. Por qué la IA generativa ha cambiado la percepción pública de la inteligencia artificial.

9. La revolución del lenguaje: cuando la IA aprende a conversar

9.1. El lenguaje como centro de la inteligencia humana y cultural.

9.2. La importancia de los grandes modelos de lenguaje.

9.3. Conversar, resumir, explicar, traducir, ordenar ideas y redactar.

9.4. Por qué el diálogo con una IA cambia nuestra relación con el conocimiento.

10. Impacto en el trabajo intelectual y creativo

10.1. La IA como apoyo para escribir, investigar, programar y diseñar.

10.2. Nuevas formas de productividad y organización de ideas.

10.3. Creatividad asistida: inspiración, borradores, imágenes, música y narración.

10.4. Riesgo de dependencia, superficialidad y pérdida de criterio propio.

11. Impacto en la educación y el aprendizaje

11.1. La IA como tutor, acompañante de estudio y herramienta explicativa.

11.2. Aprender preguntando: del manual cerrado al diálogo interactivo.

11.3. Riesgos: copiar sin comprender, errores y falsa seguridad.

11.4. Hacia una educación que enseñe a usar la IA con criterio.

12. Impacto en la empresa, la economía y la vida cotidiana

12.1. Automatización de tareas administrativas, análisis y atención al cliente.

12.2. Nuevas profesiones, nuevos procesos y transformación del empleo.

12.3. La IA en el móvil, el buscador, el correo, la imagen y los asistentes digitales.

12.4. Una tecnología invisible que empieza a integrarse en la rutina diaria.

13. Riesgos, límites y dilemas éticos

13.1. Sesgos, errores, privacidad y uso de datos.

13.2. Desinformación, imágenes falsas y manipulación de contenidos.

13.3. El problema de la autoría y los derechos de creación.

13.4. La necesidad de regulación, transparencia y responsabilidad humana.

14. La inteligencia artificial como nueva frontera cultural

14.1. No solo una herramienta: una nueva forma de relación con el conocimiento.

14.2. La IA como espejo de nuestras capacidades y limitaciones.

14.3. Entre la promesa técnica y la pregunta filosófica.

14.4. Qué significa seguir siendo humanos en una era de máquinas inteligentes.

15. Conclusión: una tecnología que obliga a pensar

15.1. La IA como oportunidad de aprendizaje, creación y mejora.

15.2. La importancia del criterio humano frente a la automatización.

15.3. Un cambio histórico comparable a otras grandes revoluciones técnicas.

15.4. La inteligencia artificial como inicio de una nueva etapa del conocimiento.

1. Introducción general: una revolución silenciosa y profunda

1.1. La inteligencia artificial como uno de los grandes cambios culturales del siglo XXI.

1.2. De la herramienta técnica al fenómeno social.

1.3. Por qué la IA afecta al conocimiento, al trabajo y a la vida cotidiana.

1.4. Entre fascinación, utilidad, incertidumbre y responsabilidad.

La inteligencia artificial ha dejado de ser una promesa lejana para convertirse en una presencia cotidiana. Durante mucho tiempo fue un asunto reservado a laboratorios, universidades, empresas tecnológicas o relatos de ciencia ficción. Se hablaba de ella como de una posibilidad futura, una frontera todavía borrosa, algo que tal vez llegaría algún día. Sin embargo, ese futuro ha empezado a ocupar el presente. Hoy la inteligencia artificial aparece en buscadores, teléfonos móviles, asistentes digitales, traductores automáticos, sistemas de recomendación, programas de diseño, herramientas de escritura, plataformas educativas, diagnósticos médicos, procesos empresariales y aplicaciones creativas. Muchas veces está ahí sin que la veamos del todo, trabajando en segundo plano, ordenando información, reconociendo patrones, sugiriendo respuestas o facilitando tareas que antes dependían por completo del esfuerzo humano.

Lo importante de este cambio no es solo técnico. La inteligencia artificial no debe entenderse únicamente como una nueva herramienta informática, comparable a un programa más avanzado o a una máquina más eficiente. Su impacto es más amplio, porque afecta a la manera en que producimos conocimiento, organizamos el trabajo, aprendemos, escribimos, investigamos, tomamos decisiones y nos relacionamos con la información. En ese sentido, la IA se está convirtiendo en uno de los grandes fenómenos culturales del siglo XXI. No transforma solo la industria tecnológica; transforma también la vida intelectual, la educación, la empresa, la creatividad y la experiencia diaria de millones de personas.

Esta revolución resulta especialmente profunda porque toca una zona muy sensible: las capacidades que solemos asociar a la inteligencia humana. Hasta hace poco, muchas máquinas podían calcular, repetir procesos, mover piezas, almacenar datos o ejecutar órdenes. Pero la inteligencia artificial contemporánea parece hacer algo distinto: conversa, resume, traduce, redacta, identifica imágenes, genera textos, crea diseños, responde preguntas y ayuda a estructurar ideas. Aunque no piense como una persona ni tenga conciencia, su capacidad para imitar ciertas tareas intelectuales obliga a replantear nuestra relación con la tecnología. Ya no estamos solo ante máquinas que sustituyen fuerza física o automatizan rutinas; estamos ante sistemas que colaboran en tareas relacionadas con el lenguaje, el razonamiento práctico y la creación.

Por eso la inteligencia artificial provoca una mezcla de entusiasmo e inquietud. Entusiasmo, porque ofrece posibilidades enormes: puede ayudar a aprender mejor, ahorrar tiempo, mejorar procesos, hacer más accesible el conocimiento, apoyar la creatividad y abrir nuevas formas de trabajo. Inquietud, porque también plantea riesgos importantes: errores, sesgos, dependencia excesiva, pérdida de criterio, problemas de privacidad, uso indebido de datos, desinformación, imágenes falsas o cambios profundos en el empleo. Como ocurre con toda gran tecnología, la IA no es buena o mala por sí misma. Su valor dependerá de cómo se diseñe, cómo se regule, cómo se utilice y qué papel conserve la responsabilidad humana.

Este primer epígrafe servirá como entrada general a ese mundo. Antes de recorrer la historia de la inteligencia artificial, sus etapas técnicas y sus aplicaciones actuales, conviene situar el fenómeno en su verdadera escala. La IA no es solo un avance espectacular de la informática, sino una nueva forma de mediación entre las personas y el conocimiento. Nos ayuda, nos desafía y nos obliga a pensar. En ella se cruzan ciencia, economía, lenguaje, cultura, educación y ética. Comprenderla no significa aceptar ingenuamente todas sus promesas ni rechazarla por miedo, sino mirarla con atención, con curiosidad y con criterio. Ahí empieza el recorrido: en reconocer que estamos ante una revolución silenciosa, pero profunda, que ya está cambiando nuestra manera de vivir, trabajar y entender el mundo.

1.1. La inteligencia artificial como uno de los grandes cambios culturales del siglo XXI

La inteligencia artificial se ha convertido en uno de los grandes cambios culturales del siglo XXI porque no afecta solo a las máquinas, sino a la forma en que las personas pensamos, trabajamos, aprendemos y creamos. Durante mucho tiempo, la tecnología se entendió principalmente como una ayuda material: herramientas para construir, transportar, fabricar, medir, comunicar o almacenar información. La rueda, la imprenta, el motor, la electricidad, el teléfono o el ordenador modificaron profundamente la vida humana porque ampliaron nuestras capacidades físicas, comunicativas y productivas. La inteligencia artificial introduce un matiz nuevo: no solo amplía lo que podemos hacer con las manos o con los instrumentos, sino también lo que podemos hacer con el lenguaje, los datos, las imágenes, las decisiones y las ideas.

Ese es el motivo por el que su impacto resulta tan profundo. La IA no se limita a acelerar procesos técnicos, sino que entra en terrenos que hasta hace poco parecían reservados casi por completo a la inteligencia humana: escribir un texto, resumir un documento, traducir un idioma, reconocer una imagen, ordenar una investigación, generar una ilustración, componer una respuesta, detectar patrones en grandes cantidades de información o mantener una conversación útil con una persona. Aunque estos sistemas no piensen como nosotros ni tengan conciencia, su capacidad para simular tareas intelectuales cambia nuestra relación con el conocimiento. Por primera vez, una herramienta digital no solo ejecuta una orden cerrada, sino que puede acompañar un proceso mental, sugerir caminos, ofrecer explicaciones y participar en tareas creativas.

Por eso la inteligencia artificial no debe entenderse únicamente como una innovación informática. Es también un fenómeno cultural, porque modifica hábitos, expectativas y formas de comportamiento. Igual que internet cambió la manera de buscar información, comunicarse y acceder al mundo, la IA está cambiando la manera de preguntar, aprender, producir contenidos y resolver problemas. Antes, para obtener una respuesta era habitual acudir a un libro, consultar una enciclopedia, buscar en una web o preguntar a una persona experta. Ahora es posible dialogar con un sistema artificial que organiza la información, la adapta al nivel del usuario y ofrece una respuesta inmediata. Esto no elimina la necesidad de verificar, leer o pensar, pero sí cambia el punto de partida.

La cultura contemporánea vive cada vez más rodeada de sistemas inteligentes. Los vemos en los buscadores, en las recomendaciones de música y vídeo, en la publicidad personalizada, en los asistentes de voz, en los traductores, en los programas de edición, en los sistemas de navegación, en los filtros de imagen, en la medicina, en la banca, en la educación y en la empresa. Muchas veces no los percibimos como inteligencia artificial porque ya se han integrado en la rutina. Esa invisibilidad es significativa: una tecnología se vuelve verdaderamente cultural cuando deja de parecer excepcional y empieza a formar parte del modo normal de vivir.

Pero el cambio más visible ha llegado con la inteligencia artificial generativa, capaz de producir textos, imágenes, código, música, resúmenes o propuestas creativas. Ahí la IA ha dejado de ser una tecnología escondida en el fondo de una plataforma y se ha convertido en una presencia directa, conversacional, casi cotidiana. El usuario ya no solo recibe recomendaciones automáticas; ahora puede pedir, corregir, matizar, ampliar y construir con ayuda de la máquina. Esto transforma la relación entre persona y herramienta. La IA no sustituye necesariamente al ser humano, pero sí introduce una nueva forma de colaboración, en la que el criterio humano debe dirigir, revisar y dar sentido al resultado.

Como todo gran cambio cultural, la inteligencia artificial despierta entusiasmo y preocupación. Puede democratizar el acceso a ciertas formas de ayuda intelectual, facilitar el aprendizaje, mejorar la productividad y abrir posibilidades creativas. Pero también puede favorecer la dependencia, la superficialidad, la desinformación o la pérdida de habilidades si se usa sin reflexión. Su importancia no reside solo en lo que puede hacer, sino en cómo nos obliga a pensar qué queremos delegar, qué debemos conservar y qué papel debe tener la responsabilidad humana en un mundo cada vez más automatizado.

En este sentido, la inteligencia artificial es uno de los grandes signos de nuestro tiempo. No es simplemente una moda tecnológica ni una herramienta pasajera. Es una nueva capa de mediación entre el ser humano y la realidad: una forma de organizar información, interpretar datos, producir lenguaje y ampliar capacidades. Como ocurrió con la escritura, la imprenta, la electricidad o internet, su verdadero alcance no se medirá solo por sus avances técnicos, sino por la manera en que transforme nuestra cultura, nuestro trabajo y nuestra forma de entender la inteligencia.

La inteligencia artificial como red invisible de información. La inteligencia artificial no aparece siempre como una máquina visible. Muchas veces funciona como una red de datos, conexiones y patrones que opera en segundo plano, organizando información y ayudando a tomar decisiones. © Keyfame / Envato Elements.

1.2. De la herramienta técnica al fenómeno social

Durante mucho tiempo, la inteligencia artificial fue percibida como una tecnología lejana, especializada y difícil de comprender. Parecía pertenecer al mundo de los ingenieros, los laboratorios, las grandes empresas informáticas o las universidades. Su presencia estaba asociada a sistemas complejos, programas de análisis, robots industriales, cálculos científicos o procesos invisibles que funcionaban detrás de las pantallas. Para la mayoría de las personas, la IA era algo de lo que se oía hablar, pero no algo con lo que se pudiera convivir de manera directa. Era una herramienta técnica, poderosa pero distante.

Ese panorama ha cambiado con rapidez. La inteligencia artificial ha pasado de estar oculta en sistemas especializados a convertirse en una experiencia cotidiana. Hoy una persona puede hablar con una IA, pedirle que le explique un concepto, que resuma un texto, que proponga ideas, que traduzca un párrafo, que genere una imagen, que revise un código o que ayude a organizar una tarea. Esta cercanía ha cambiado completamente su significado social. Ya no se trata solo de una tecnología que actúa en el fondo de una plataforma, sino de una herramienta visible, accesible y conversacional. La IA ha salido del laboratorio y ha entrado en la vida diaria.

Este paso de lo técnico a lo social es decisivo. Una tecnología se vuelve verdaderamente importante cuando deja de ser usada solo por especialistas y empieza a modificar hábitos comunes. El automóvil no transformó la sociedad solo porque fuera una máquina ingeniosa, sino porque cambió la movilidad, la ciudad, el comercio, el ocio y la organización del territorio. Internet no fue únicamente una red informática, sino un nuevo espacio de comunicación, búsqueda, trabajo y relación. Del mismo modo, la inteligencia artificial está dejando de ser una innovación aislada para convertirse en una nueva capa de la vida social: una mediación entre las personas y la información, entre el usuario y el conocimiento, entre la creatividad humana y las herramientas digitales.

Su impacto se nota en muchos ámbitos. En la educación, puede actuar como apoyo para estudiar, repasar o recibir explicaciones adaptadas. En la empresa, permite automatizar tareas, analizar datos, redactar documentos o mejorar la atención al cliente. En la cultura, ayuda a producir textos, imágenes, guiones, diseños o materiales divulgativos. En la vida cotidiana, aparece en traductores, buscadores, asistentes, recomendaciones, filtros, aplicaciones de productividad o sistemas de navegación. Muchas veces usamos inteligencia artificial sin nombrarla, porque ya está integrada en servicios que consideramos normales.

Pero precisamente por eso conviene mirarla con atención. Cuando una tecnología se vuelve social, sus consecuencias dejan de ser puramente técnicas. Ya no importa solo si funciona bien, sino cómo afecta al empleo, a la educación, a la privacidad, a la creatividad, a la confianza pública y a la forma de relacionarnos con la información. Una IA puede ayudar a escribir mejor, pero también puede producir textos superficiales si se usa sin criterio. Puede facilitar el aprendizaje, pero también fomentar que alguien copie sin comprender. Puede ahorrar tiempo, pero también generar dependencia. Puede abrir oportunidades, pero también ampliar desigualdades si solo algunos saben utilizarla bien.

El fenómeno social de la inteligencia artificial exige, por tanto, una nueva alfabetización. No basta con saber que existe ni con usarla de manera automática. Hay que aprender a preguntarle bien, a revisar sus respuestas, a entender sus límites, a proteger los datos personales y a distinguir entre ayuda útil y delegación irresponsable. La IA puede convertirse en una herramienta magnífica, pero no debe ocupar el lugar del juicio humano. Su utilidad aumenta cuando la persona conserva el control: cuando sabe qué busca, por qué lo busca y cómo evaluar el resultado recibido.

La inteligencia artificial ha dejado de ser un simple instrumento técnico porque ha empezado a influir en la manera en que las sociedades producen conocimiento, organizan el trabajo y construyen cultura. Ese cambio la sitúa en el centro de muchos debates actuales. No estamos ante una máquina más, sino ante una tecnología que modifica comportamientos, expectativas y formas de pensar. Por eso comprender la IA no es solo una cuestión de informática, sino también de educación, ética, economía y cultura. Su verdadero impacto no se mide únicamente por lo que puede hacer, sino por el modo en que está cambiando nuestra vida común.

1.3. Por qué la IA afecta al conocimiento, al trabajo y a la vida cotidiana

La inteligencia artificial afecta al conocimiento, al trabajo y a la vida cotidiana porque actúa precisamente sobre tres actividades básicas de nuestra época: manejar información, tomar decisiones y producir resultados. Vivimos rodeados de datos, textos, imágenes, mensajes, documentos, trámites, búsquedas, tareas repetitivas y necesidades de comunicación. La IA entra en ese espacio como una tecnología capaz de ordenar, resumir, clasificar, comparar, generar y recomendar. No cambia solo una herramienta concreta, sino el modo en que nos relacionamos con muchas actividades diarias que antes dependían por completo de nuestra atención, nuestro tiempo y nuestra capacidad de organización.

En el terreno del conocimiento, la transformación es especialmente clara. Durante siglos, aprender implicaba acceder a libros, escuchar a maestros, consultar bibliotecas, tomar apuntes y construir pacientemente una comprensión propia. Todo eso sigue siendo importante, pero la IA introduce una nueva forma de acceso: el diálogo inmediato. Una persona puede preguntar por un concepto, pedir una explicación más sencilla, solicitar ejemplos, comparar teorías, resumir un texto o convertir una idea confusa en un esquema ordenado. Esto no elimina la lectura ni el estudio profundo, pero cambia la puerta de entrada al aprendizaje. La IA puede hacer más accesible el conocimiento, sobre todo cuando se usa como apoyo para orientarse, repasar o aclarar dudas.

Sin embargo, esa facilidad también exige prudencia. La inteligencia artificial puede responder con seguridad incluso cuando se equivoca, puede simplificar demasiado un asunto o presentar como claro algo que requiere matices. Por eso su impacto en el conocimiento no debe entenderse como una sustitución del pensamiento humano, sino como una ampliación que necesita revisión. La IA puede ayudar a aprender, pero no puede aprender por nosotros. Puede ofrecer una explicación inicial, pero el criterio, la comprensión profunda y la responsabilidad siguen perteneciendo a la persona. En este sentido, su buen uso depende de una actitud activa: preguntar mejor, contrastar, leer, corregir y no aceptar automáticamente todo lo que aparece en pantalla.

En el mundo del trabajo, la IA afecta tanto a las tareas simples como a las actividades intelectuales. Puede automatizar procesos administrativos, redactar borradores, analizar datos, generar informes, traducir documentos, clasificar correos, preparar presentaciones, ayudar en programación o acelerar búsquedas. Esto modifica la productividad y también la organización del tiempo. Muchas tareas que antes ocupaban horas pueden resolverse en menos tiempo, mientras que otras cambian de naturaleza: ya no se trata solo de hacer desde cero, sino de dirigir, revisar, seleccionar y mejorar lo que una herramienta propone. El trabajador no desaparece necesariamente, pero su función puede desplazarse hacia el criterio, la supervisión y la toma de decisiones.

Ese cambio genera oportunidades, pero también inquietudes. Algunas profesiones pueden transformarse profundamente; otras necesitarán nuevas competencias; y muchas personas tendrán que aprender a convivir con sistemas inteligentes en su actividad diaria. La IA puede liberar tiempo de tareas mecánicas, pero también puede aumentar la presión por producir más. Puede mejorar procesos, pero también crear dependencia o desigualdad entre quienes saben utilizarla y quienes quedan al margen. Por eso su impacto laboral no es solo técnico: es social, económico y humano.

En la vida cotidiana, la inteligencia artificial ya está mucho más presente de lo que parece. Interviene en recomendaciones de música o vídeo, rutas de navegación, filtros fotográficos, traducciones, asistentes digitales, compras en línea, publicidad personalizada, sistemas de seguridad, atención automática y herramientas de escritura. Muchas veces no la vemos porque se ha integrado de forma silenciosa en aplicaciones habituales. Su presencia se vuelve normal, casi invisible, hasta que nos damos cuenta de que muchas decisiones pequeñas están mediadas por algoritmos.

Por todo ello, la IA afecta a nuestra manera de conocer, trabajar y vivir. No es una tecnología aislada, sino una capa que se está incorporando a la experiencia diaria. Puede ser una aliada extraordinaria si se usa con inteligencia humana, pero también puede empobrecer la atención, el juicio y la autonomía si se utiliza de forma pasiva. Su importancia no está solo en lo que hace, sino en cómo nos obliga a reorganizar nuestra relación con el tiempo, la información y la responsabilidad personal.

1.4. Entre fascinación, utilidad, incertidumbre y responsabilidad

La inteligencia artificial despierta una mezcla muy particular de sensaciones. Por un lado, fascina. Hay algo sorprendente en poder conversar con un sistema artificial, pedirle que explique un tema difícil, que resuma un texto, que genere una imagen, que ayude a escribir, que traduzca, que ordene ideas o que proponga soluciones. Durante mucho tiempo, esas capacidades parecían reservadas a la imaginación futurista. Hoy forman parte de herramientas reales, disponibles para millones de personas. Esa cercanía produce asombro, porque la IA parece situarnos ante una frontera nueva: la posibilidad de que una máquina participe en tareas que antes asociábamos casi exclusivamente al pensamiento humano.

Pero la fascinación no debe ocultar la utilidad concreta. La inteligencia artificial no es solo una tecnología llamativa; puede ser una herramienta muy práctica. Ayuda a ahorrar tiempo, facilita el acceso al conocimiento, permite organizar información, apoya procesos creativos, mejora la productividad y puede servir de acompañamiento en el aprendizaje. Para un estudiante, puede convertirse en una guía inicial; para un trabajador, en un apoyo para tareas repetitivas o documentales; para un creador, en una fuente de ideas; para una empresa, en un sistema de análisis, automatización o atención. Su fuerza está precisamente en que puede adaptarse a muchos contextos distintos.

Sin embargo, esa misma potencia abre un espacio de incertidumbre. La IA no es una herramienta completamente transparente. Muchas veces no sabemos con claridad cómo llega a una respuesta, qué datos han influido en su funcionamiento o por qué comete determinados errores. Además, puede producir textos convincentes pero incorrectos, imágenes falsas muy realistas, respuestas sesgadas o interpretaciones incompletas. El hecho de que escriba con seguridad no significa que siempre tenga razón. Esta es una de las grandes dificultades de la inteligencia artificial actual: puede parecer más fiable de lo que realmente es si el usuario no conserva una actitud crítica.

También existe incertidumbre sobre sus consecuencias sociales. No sabemos todavía hasta dónde transformará el empleo, la educación, la creación artística, la administración pública, la investigación o la vida cotidiana. Algunas tareas desaparecerán, otras cambiarán y muchas nuevas aparecerán. Habrá oportunidades, pero también tensiones. La IA puede democratizar ciertas capacidades, pero también concentrar poder en grandes empresas tecnológicas. Puede mejorar servicios, pero también invadir la privacidad. Puede ampliar la creatividad, pero también generar saturación de contenidos automáticos. Por eso no basta con celebrar sus avances; hay que pensar sus efectos.

En este punto aparece la responsabilidad. La inteligencia artificial no debe ser utilizada como si fuera una autoridad incuestionable ni como una máquina mágica que resuelve todo. Debe ser tratada como una herramienta poderosa, útil pero limitada. El ser humano sigue teniendo que decidir qué pregunta hace, qué respuesta acepta, qué información verifica y qué uso da al resultado. La responsabilidad no desaparece porque intervenga una máquina. Al contrario, aumenta, porque ahora disponemos de medios más rápidos y potentes para producir, difundir o transformar información.

La cuestión central no es si debemos admirar o temer la inteligencia artificial, sino cómo aprender a convivir con ella de forma lúcida. Fascinación, utilidad, incertidumbre y responsabilidad forman parte del mismo fenómeno. La fascinación nos impulsa a explorarla; la utilidad nos muestra su valor práctico; la incertidumbre nos obliga a ser prudentes; y la responsabilidad nos recuerda que ninguna tecnología debe sustituir al juicio humano. Comprender la IA exige mantener juntas esas cuatro dimensiones. Solo así podremos aprovechar sus posibilidades sin olvidar sus riesgos, y convertir una revolución técnica en una oportunidad real de conocimiento, creatividad y mejora humana.

2. Qué entendemos por inteligencia artificial

2.1. La idea básica: máquinas capaces de realizar tareas asociadas a la inteligencia humana.

2.2. Inteligencia, cálculo, lenguaje, aprendizaje y decisión.

2.3. Diferencia entre automatización, informática tradicional e inteligencia artificial.

2.4. Por qué la IA no “piensa” como una persona, aunque pueda simular tareas inteligentes.

Antes de recorrer la historia de la inteligencia artificial y sus distintas etapas, conviene aclarar qué queremos decir cuando usamos esta expresión. La palabra “inteligencia” tiene mucho peso, y por eso puede llevar a confusión. Cuando hablamos de inteligencia artificial no estamos diciendo necesariamente que una máquina tenga conciencia, emociones, voluntad propia o comprensión humana del mundo. Hablamos, más bien, de sistemas capaces de realizar tareas que, si las hiciera una persona, consideraríamos relacionadas con la inteligencia: reconocer imágenes, traducir textos, responder preguntas, aprender de ejemplos, detectar patrones, clasificar información, tomar decisiones dentro de ciertos límites o generar contenidos nuevos a partir de datos previos.

La inteligencia artificial no es una sola cosa. Es un campo amplio que reúne métodos, modelos y técnicas diferentes. Algunos sistemas están diseñados para reconocer rostros o diagnosticar anomalías en una imagen médica; otros sirven para recomendar canciones, detectar fraudes, traducir idiomas, conducir vehículos, jugar al ajedrez, escribir textos o conversar con usuarios. Todos estos ejemplos son distintos, pero comparten una idea común: la máquina no se limita a ejecutar una orden simple y repetitiva, sino que procesa información de una forma más flexible, adaptándose a datos, contextos o patrones.

Esto marca una diferencia importante respecto a la informática tradicional. Un programa clásico funciona siguiendo instrucciones muy precisas escritas por una persona: si ocurre una cosa, debe hacer otra. Es una lógica cerrada, útil y poderosa, pero limitada a lo que se ha previsto de antemano. La inteligencia artificial, en cambio, especialmente en sus formas modernas, puede aprender de grandes cantidades de datos y ajustar su comportamiento a partir de ejemplos. No necesita que alguien le escriba una regla para cada caso concreto. Puede encontrar regularidades, hacer predicciones y producir respuestas nuevas dentro del marco para el que ha sido entrenada.

Sin embargo, hay que tener cuidado con las palabras. Decir que una IA “aprende”, “responde” o “decide” no significa que lo haga del mismo modo que una persona. Un ser humano aprende con cuerpo, memoria, experiencia, emociones, contexto social, intención y conciencia. Una IA aprende de otra manera: mediante datos, cálculos, patrones y modelos matemáticos. Puede simular resultados inteligentes, pero no vive el mundo. Puede generar una explicación brillante, pero no comprende la realidad desde dentro como lo hace una mente humana. Esta distinción es esencial para evitar tanto la ingenuidad como el rechazo simplista.

La inteligencia artificial, por tanto, debe entenderse como una tecnología de simulación funcional de ciertas capacidades inteligentes. No reproduce la inteligencia humana completa, pero puede imitar algunas de sus tareas con gran eficacia. Ahí está su fuerza y también su límite. Su fuerza consiste en procesar enormes cantidades de información, encontrar relaciones invisibles para nosotros y ayudar en tareas complejas. Su límite está en que carece de conciencia, experiencia vital, sentido moral propio y comprensión humana profunda. Puede ser muy útil, pero no debe confundirse con una persona.

Comprender esto es fundamental para usarla bien. La IA no es magia, ni una mente encerrada en una máquina, ni una simple calculadora ampliada. Es una tecnología poderosa que trabaja con información y patrones para producir resultados que nos parecen inteligentes. Cuanto mejor entendamos su naturaleza, mejor podremos aprovecharla sin idealizarla. El reto consiste en reconocer su utilidad sin atribuirle cualidades humanas que no posee, y en mantener siempre el criterio humano como guía de su uso.

2.1. La idea básica: máquinas capaces de realizar tareas asociadas a la inteligencia humana

La idea más sencilla de la inteligencia artificial es esta: crear sistemas capaces de realizar tareas que normalmente asociamos a la inteligencia humana. No significa que la máquina sea inteligente del mismo modo que una persona, ni que tenga conciencia, emociones o voluntad. Significa que puede llevar a cabo actividades que, vistas desde fuera, parecen requerir alguna forma de inteligencia: reconocer una imagen, traducir una frase, responder una pregunta, clasificar información, aprender de ejemplos, jugar una partida, detectar un error, recomendar una decisión o generar un texto coherente.

Esta definición resulta útil porque evita dos extremos. Por un lado, impide imaginar la inteligencia artificial como una especie de mente humana artificial, casi como si hubiera una persona dentro de la máquina. Por otro, evita reducirla a una simple calculadora. La IA no piensa como nosotros, pero tampoco se limita siempre a ejecutar instrucciones mecánicas de forma rígida. Su interés está precisamente en esa zona intermedia: sistemas que no son humanos, pero que pueden imitar, apoyar o reproducir algunas tareas propias de la inteligencia humana.

Durante mucho tiempo, las máquinas fueron diseñadas para ampliar nuestra fuerza física o nuestra capacidad de cálculo. Un motor mueve más peso que un cuerpo humano; una calculadora resuelve operaciones más rápido que una persona; un ordenador almacena millones de datos sin olvidarlos. La inteligencia artificial da un paso distinto: intenta ampliar capacidades relacionadas con el conocimiento, la percepción y la decisión. Por ejemplo, un sistema de IA puede analizar miles de imágenes médicas para detectar señales de una enfermedad, identificar patrones de consumo en una empresa, traducir entre idiomas o ayudar a una persona a redactar una explicación clara sobre un tema complejo.

Lo importante es que estas tareas no se resuelven siempre con una instrucción fija y sencilla. Reconocer un gato en una fotografía, entender el sentido aproximado de una frase, distinguir un correo normal de un mensaje fraudulento o proponer una respuesta adecuada en una conversación exige manejar variaciones, contextos y posibilidades. Una fotografía puede tener distinta luz, fondo, tamaño o ángulo; una frase puede tener matices; una decisión puede depender de muchos datos. La IA trabaja precisamente con esa complejidad, buscando patrones que le permitan ofrecer una respuesta útil.

En sus formas más modernas, la inteligencia artificial aprende a partir de ejemplos. En lugar de programar una regla para cada situación posible, se entrena un sistema con grandes cantidades de datos para que detecte regularidades. Si se le muestran muchas imágenes clasificadas, puede aprender a reconocer formas similares. Si se le alimenta con grandes volúmenes de texto, puede aprender relaciones entre palabras, estilos, estructuras y contextos. Este aprendizaje no es humano, porque no implica comprensión vital del mundo, pero sí permite producir resultados eficaces en muchas tareas.

Por eso conviene entender la inteligencia artificial como una tecnología de apoyo a tareas inteligentes. No sustituye de manera total la inteligencia humana, pero puede colaborar con ella. Puede hacer más rápido lo que antes era lento, más accesible lo que antes requería conocimientos técnicos, o más manejable lo que antes resultaba demasiado grande para una sola persona. Su valor aparece cuando ayuda a ver, ordenar, comparar, traducir, resumir, generar o decidir con más información.

La idea básica, por tanto, no es que las máquinas se conviertan en personas, sino que puedan realizar ciertas funciones que antes dependían exclusivamente de capacidades humanas. Esta distinción es esencial. La inteligencia artificial no tiene experiencia, intención ni conciencia, pero puede operar con datos y producir respuestas que resultan inteligentes en la práctica. Ahí reside su fuerza: no en ser humana, sino en ampliar el campo de lo que las herramientas pueden hacer junto a nosotros.

2.2. Inteligencia, cálculo, lenguaje, aprendizaje y decisión

Para entender mejor qué es la inteligencia artificial, conviene separar algunas capacidades que normalmente aparecen mezcladas cuando hablamos de inteligencia. Una persona inteligente no solo calcula; también comprende situaciones, usa el lenguaje, aprende de la experiencia, relaciona ideas, toma decisiones, interpreta emociones y actúa dentro de un contexto. La inteligencia humana es amplia, viva y profundamente unida a la experiencia. La inteligencia artificial, en cambio, trabaja de otro modo: toma algunas de esas capacidades y las reproduce parcialmente mediante procedimientos técnicos.

El cálculo fue uno de los primeros terrenos donde las máquinas superaron claramente al ser humano. Un ordenador puede realizar millones de operaciones en muy poco tiempo, almacenar cantidades enormes de información y ejecutar procesos con una precisión extraordinaria. Pero calcular no equivale a comprender. Una máquina puede resolver una operación matemática compleja sin saber qué significa en la vida real. Este matiz es importante, porque la inteligencia artificial nace en parte de la potencia del cálculo, pero no se reduce a él. Su ambición es usar esa capacidad para reconocer patrones, hacer predicciones, clasificar datos o generar respuestas útiles.

El lenguaje añade una dimensión mucho más delicada. Hablar, escribir y comprender frases no consiste solo en unir palabras correctamente. El lenguaje humano contiene intención, contexto, memoria, matices, ironía, emoción y cultura. Durante mucho tiempo, lograr que una máquina manejara el lenguaje de forma flexible fue uno de los grandes desafíos de la informática. Los avances recientes han sido sorprendentes porque algunos sistemas pueden redactar textos coherentes, resumir documentos, traducir, responder preguntas y mantener conversaciones bastante naturales. Sin embargo, esto no significa que comprendan como una persona. Funcionan detectando relaciones entre palabras, estructuras y contextos aprendidos a partir de grandes cantidades de texto.

El aprendizaje es otra pieza central. En la informática tradicional, el programa hace lo que se le ordena mediante instrucciones explícitas. En la inteligencia artificial moderna, el sistema puede entrenarse con datos para mejorar su rendimiento en una tarea. Aprende patrones, no experiencias humanas. Por ejemplo, puede aprender a distinguir imágenes, prever comportamientos, recomendar productos o generar frases porque ha sido expuesto a muchos ejemplos. Este aprendizaje técnico es muy poderoso, pero también tiene límites: si los datos están sesgados, incompletos o mal seleccionados, el sistema puede reproducir errores o producir resultados poco fiables.

La decisión es quizá el aspecto más delicado. Muchas aplicaciones de IA ayudan a decidir: qué ruta tomar, qué contenido recomendar, qué cliente puede tener riesgo de impago, qué imagen médica merece más atención o qué respuesta automática ofrecer. Pero decidir no es solo calcular probabilidades. En la vida humana, decidir implica valores, consecuencias, responsabilidad y comprensión del contexto. Por eso conviene distinguir entre una IA que recomienda y una persona que asume la decisión final. La máquina puede ofrecer una estimación útil, pero no debe ocupar sin control el lugar del juicio humano, especialmente en asuntos sensibles.

Inteligencia, cálculo, lenguaje, aprendizaje y decisión forman así el núcleo de la inteligencia artificial. La IA combina capacidad de procesamiento, análisis de datos, reconocimiento de patrones y producción de respuestas. Puede parecer inteligente porque realiza tareas que antes solo hacían las personas, pero su inteligencia es funcional, no humana. No vive, no siente, no recuerda como nosotros y no comprende el mundo desde una experiencia propia.

Esta distinción no disminuye su importancia. Al contrario, ayuda a valorar mejor su alcance. La inteligencia artificial es poderosa precisamente porque puede ampliar nuestras capacidades en cálculo, lenguaje, aprendizaje y decisión. Pero su uso responsable exige no confundir eficacia técnica con sabiduría humana. La máquina puede ayudar a pensar, pero no debe sustituir la necesidad de comprender.

2.3. Diferencia entre automatización, informática tradicional e inteligencia artificial

Para entender bien la inteligencia artificial conviene distinguirla de dos conceptos cercanos: la automatización y la informática tradicional. A veces usamos estas palabras como si fueran lo mismo, pero no lo son exactamente. Todas están relacionadas con el uso de máquinas y programas para realizar tareas, pero cada una funciona con una lógica distinta. La diferencia principal está en el grado de flexibilidad, adaptación y capacidad para manejar situaciones no previstas de forma rígida.

La automatización consiste, en términos sencillos, en hacer que una máquina o un sistema realice una tarea repetitiva sin intervención humana constante. Una puerta automática que se abre al detectar movimiento, una cadena de montaje que repite una operación, un temporizador que enciende una luz o un programa que envía un correo a una hora determinada son ejemplos claros. La automatización puede ser muy útil y ahorrar mucho esfuerzo, pero normalmente trabaja con instrucciones simples y repetidas. Si ocurre A, ejecuta B. Su fuerza está en la repetición fiable, no en la interpretación compleja.

La informática tradicional va un paso más allá. Un programa informático clásico puede realizar cálculos, almacenar datos, ordenar información, ejecutar instrucciones y resolver tareas muy variadas. Pero lo hace siguiendo reglas escritas previamente por programadores. Es decir, alguien define de antemano qué debe hacer el sistema en cada caso. Un procesador de textos, una hoja de cálculo, una base de datos o un programa de facturación funcionan así en gran medida. Son herramientas poderosas, pero su comportamiento depende de instrucciones explícitas. Si el usuario introduce unos datos, el programa responde según reglas ya establecidas.

La inteligencia artificial introduce una diferencia importante: no siempre necesita que una persona programe una regla concreta para cada situación. En muchos casos, el sistema se entrena con datos para reconocer patrones y producir respuestas nuevas dentro de un marco determinado. En lugar de decirle exactamente qué debe hacer ante cada imagen, texto o caso posible, se le muestran muchos ejemplos para que aprenda relaciones. Por eso una IA puede clasificar fotografías, detectar fraudes, traducir idiomas, recomendar contenidos o generar textos sin que alguien haya escrito manualmente cada respuesta posible.

Esta diferencia se entiende bien con un ejemplo sencillo. Un filtro automático de correo podría enviar a una carpeta todos los mensajes que contengan una palabra concreta. Eso sería una automatización simple. Un programa tradicional podría aplicar varias reglas: remitente, asunto, fecha, archivos adjuntos, palabras sospechosas. Pero un sistema de inteligencia artificial puede analizar miles de ejemplos de correos legítimos y fraudulentos para detectar patrones más sutiles: tono, estructura, combinaciones de palabras, comportamiento del remitente o señales difíciles de resumir en una regla fija. No es infalible, pero puede adaptarse mejor a la variedad de casos.

Lo mismo ocurre con el lenguaje. Un programa clásico puede corregir una palabra si aparece en un diccionario. Una IA moderna puede sugerir una frase, resumir un texto, cambiar el tono de un párrafo o responder una pregunta porque ha aprendido patrones lingüísticos a gran escala. No se limita a ejecutar una orden cerrada; genera una respuesta probable y coherente según el contexto. Ahí está una de las grandes diferencias: la IA trabaja con incertidumbre, probabilidades y patrones, no solo con reglas rígidas.

Esto no significa que la inteligencia artificial sea superior en todo. Para muchas tareas, la automatización simple o la informática tradicional son más fiables, rápidas y suficientes. No hace falta IA para encender una luz, calcular una suma básica o guardar un archivo. La inteligencia artificial resulta útil cuando la tarea exige manejar variedad, ambigüedad, grandes cantidades de datos o situaciones difíciles de definir con reglas exactas.

Por tanto, la automatización repite procesos; la informática tradicional ejecuta instrucciones; la inteligencia artificial aprende patrones y se adapta dentro de ciertos límites. Comprender esta diferencia ayuda a evitar confusiones. La IA no sustituye a toda la informática, sino que añade una capa nueva: la capacidad de tratar problemas abiertos, reconocer relaciones complejas y generar respuestas flexibles. Esa es la razón por la que su impacto actual es tan amplio.

2.4. Por qué la IA no “piensa” como una persona, aunque pueda simular tareas inteligentes

Una de las confusiones más frecuentes sobre la inteligencia artificial nace del propio lenguaje que usamos para describirla. Decimos que una IA “aprende”, “responde”, “entiende”, “decide” o “crea”, y esas palabras nos llevan casi de forma natural a imaginar una mente detrás de la máquina. Sin embargo, conviene ser muy cuidadosos. La inteligencia artificial puede realizar tareas que parecen inteligentes, pero eso no significa que piense como una persona. Su funcionamiento no se basa en conciencia, experiencia vital, emociones o comprensión humana del mundo, sino en cálculos, datos, modelos y patrones.

El pensamiento humano está unido a una vida completa. Pensamos desde un cuerpo, una memoria, una historia personal, una educación, unas emociones, unos miedos, unos deseos y una relación directa con la realidad. Cuando una persona comprende una frase, no solo reconoce palabras: las conecta con experiencias, intenciones, tonos, contextos y consecuencias. Si alguien dice “tengo frío”, entendemos algo más que una información térmica. Podemos imaginar incomodidad, necesidad de abrigo, cansancio, enfermedad o una petición indirecta. La comprensión humana está llena de mundo.

La inteligencia artificial, en cambio, no vive el mundo. No tiene infancia, cuerpo, cansancio, dolor, alegría, biografía ni responsabilidad propia. Un modelo de lenguaje puede producir una respuesta muy razonable porque ha sido entrenado con enormes cantidades de texto y ha aprendido relaciones estadísticas entre palabras, ideas y contextos. Puede explicar un tema, redactar un párrafo o mantener una conversación fluida. Pero esa fluidez no equivale necesariamente a una comprensión humana. La IA trabaja con representaciones internas y probabilidades; no con experiencia consciente.

Esto no la hace inútil. Al contrario, su capacidad para simular tareas inteligentes puede ser extraordinariamente valiosa. Puede ayudar a ordenar información, detectar patrones, traducir, resumir, redactar, clasificar imágenes o generar propuestas creativas. En muchos casos, el resultado práctico es muy útil. Pero debemos distinguir entre el resultado y el proceso. Una respuesta puede parecer inteligente porque está bien escrita y es coherente, aunque el sistema que la produce no tenga una comprensión profunda de lo que dice en el mismo sentido que una persona.

Esta diferencia es esencial para usar la IA con criterio. Si creemos que la máquina “entiende” como un ser humano, podemos confiar demasiado en sus respuestas. Podemos olvidar que puede equivocarse, inventar datos, simplificar en exceso, reproducir sesgos o presentar con seguridad algo que no es correcto. La apariencia de inteligencia puede ser engañosa porque el lenguaje bien construido transmite autoridad. Una frase clara y ordenada parece fiable, pero la forma no garantiza siempre la verdad del contenido.

También hay una diferencia moral. Una persona puede ser responsable de sus decisiones porque tiene conciencia, intención y capacidad de asumir consecuencias. Una IA no tiene responsabilidad propia. Si se utiliza para tomar decisiones importantes, la responsabilidad sigue perteneciendo a quienes la diseñan, la aplican o aceptan sus resultados. Esto es especialmente importante en medicina, justicia, educación, contratación laboral o gestión de datos personales. La máquina puede recomendar, pero no debe convertirse en autoridad ciega.

Por eso conviene entender la inteligencia artificial como una herramienta muy avanzada, no como una mente humana artificial. Puede imitar partes del comportamiento inteligente, pero no reproduce la totalidad de la inteligencia humana. Puede manejar lenguaje, pero no vive las palabras. Puede generar imágenes, pero no desea crear belleza. Puede responder sobre ética, pero no tiene conciencia moral. Puede ayudar a pensar, pero no piensa desde una existencia propia.

Esta distinción no reduce el interés de la IA; lo hace más claro. Su grandeza está en que amplía nuestras capacidades, no en que sustituya por completo nuestra inteligencia. Bien utilizada, puede convertirse en una aliada poderosa para aprender, crear y trabajar. Mal entendida, puede llevarnos a delegar demasiado y a confundir simulación con comprensión. El reto consiste en aprovechar su eficacia sin olvidar lo fundamental: la inteligencia humana no es solo producir respuestas, sino comprender, sentir, valorar, decidir y asumir responsabilidad en el mundo real.

3. El viejo sueño de crear inteligencia artificial

3.1. Autómatas, mitos y máquinas imaginadas antes de la informática.

3.2. La modernidad técnica: lógica, cálculo y primeros computadores.

3.3. Alan Turing y la pregunta por la inteligencia de las máquinas.

3.4. El nacimiento formal de la inteligencia artificial en el siglo XX.

La inteligencia artificial puede parecer una tecnología muy reciente, ligada a ordenadores potentes, grandes bases de datos, internet y modelos capaces de conversar. Sin embargo, la idea de crear una inteligencia no humana es mucho más antigua que la informática. Antes de que existieran los computadores, las personas ya imaginaban figuras artificiales capaces de moverse, hablar, obedecer, calcular o imitar algún aspecto de la vida. En los mitos, en los autómatas mecánicos, en las leyendas y en los primeros proyectos técnicos aparece una aspiración persistente: fabricar algo que no sea humano, pero que parezca participar de algunas capacidades humanas.

Ese sueño tiene una raíz profunda. El ser humano siempre ha querido ampliar sus fuerzas, vencer sus límites y proyectar su imaginación sobre la materia. Crear una máquina inteligente no es solo resolver un problema técnico; es tocar una pregunta más antigua: qué nos hace inteligentes, qué diferencia a una persona de un mecanismo, qué puede imitarse y qué queda fuera de toda imitación. Por eso la historia de la inteligencia artificial no empieza únicamente en los laboratorios del siglo XX, sino en una larga tradición de fascinación por los autómatas, los relojes complejos, las máquinas de cálculo y las criaturas artificiales.

Con la modernidad, ese sueño empezó a tomar una forma más racional. La lógica, las matemáticas y la ingeniería abrieron la posibilidad de pensar el razonamiento como un proceso ordenado, susceptible de ser formalizado. Si ciertos razonamientos podían expresarse mediante reglas, símbolos y cálculos, tal vez una máquina podría ejecutarlos. Esta idea fue decisiva: antes de construir máquinas inteligentes, hubo que imaginar que algunas partes del pensamiento podían traducirse a procedimientos. La inteligencia artificial nació, en cierto modo, cuando la inteligencia comenzó a verse también como una operación que podía describirse, analizarse y reproducirse parcialmente.

Los primeros computadores dieron un paso decisivo. Ya no se trataba solo de mecanismos capaces de moverse o de calcular operaciones aisladas, sino de máquinas programables, capaces de ejecutar instrucciones, manipular símbolos y procesar información. En ese contexto apareció una figura fundamental: Alan Turing, que planteó de forma moderna la pregunta por la inteligencia de las máquinas. Su reflexión no se limitaba a si una máquina podía “tener mente”, sino a si podía comportarse de tal manera que sus respuestas fueran indistinguibles de las de una persona en una conversación. Con ello, la inteligencia artificial dejó de ser solo una fantasía y empezó a convertirse en un problema científico.

Este epígrafe recorrerá ese camino inicial: desde los mitos y autómatas hasta la lógica moderna, los primeros computadores y el nacimiento formal de la inteligencia artificial como campo de estudio. Es importante hacerlo porque permite comprender que la IA actual no surge de la nada. Detrás de los sistemas contemporáneos hay siglos de imaginación técnica, preguntas filosóficas y avances matemáticos. La inteligencia artificial es nueva en sus herramientas, pero antigua en su deseo: crear máquinas capaces de imitar, ampliar o acompañar algunas de las funciones más sorprendentes de la mente humana.

3.1. Autómatas, mitos y máquinas imaginadas antes de la informática

Antes de que existieran los ordenadores, los algoritmos modernos o los modelos de inteligencia artificial, el ser humano ya había imaginado la posibilidad de crear seres artificiales. La idea de fabricar algo que se mueva, obedezca, hable o imite la vida aparece desde muy antiguo en mitos, leyendas, relatos religiosos, mecanismos de entretenimiento y proyectos técnicos. La inteligencia artificial contemporánea pertenece al mundo de la informática, pero su raíz imaginaria es mucho más antigua: nace del deseo humano de dar forma a una criatura, una máquina o un artefacto capaz de realizar acciones propias de los seres vivos.

En muchas culturas antiguas aparecen figuras que anticipan, de manera simbólica, este sueño. La mitología griega hablaba de autómatas divinos, estatuas animadas y seres fabricados por dioses o artesanos extraordinarios. Hefesto, el dios herrero, era imaginado como creador de mecanismos capaces de moverse por sí mismos. El mito de Pigmalión, aunque centrado en una estatua que cobra vida por intervención divina, expresa también esa fascinación por la frontera entre lo artificial y lo vivo. En otros relatos, la creación de seres artificiales aparece unida al poder, al conocimiento prohibido o al deseo de superar los límites humanos.

Durante siglos, esa imaginación convivió con la fabricación real de autómatas mecánicos. Relojeros, ingenieros y artesanos construyeron figuras capaces de tocar instrumentos, escribir, mover brazos, girar la cabeza o imitar animales. Estos mecanismos no eran inteligentes en el sentido moderno, pero producían asombro porque parecían simular vida. Un pájaro mecánico que cantaba, una figura que escribía o un muñeco que ejecutaba movimientos ordenados hacían visible una idea poderosa: ciertas acciones podían ser descompuestas en partes, engranajes y secuencias. Lo que parecía natural podía, al menos en apariencia, reproducirse mediante técnica.

Estos autómatas tenían un valor doble. Por un lado, eran objetos de espectáculo, lujo y entretenimiento. Mostraban la habilidad de sus creadores y despertaban admiración en cortes, ferias o gabinetes científicos. Por otro, abrían una pregunta más profunda: si una máquina podía imitar el movimiento, ¿podría algún día imitar también el pensamiento? La respuesta todavía estaba muy lejos, pero la pregunta empezaba a tomar forma. Cada autómata era una pequeña demostración de que lo humano podía ser observado, analizado y parcialmente reproducido.

La diferencia con la inteligencia artificial moderna es evidente. Aquellos mecanismos no aprendían, no interpretaban, no conversaban ni tomaban decisiones reales. Funcionaban mediante resortes, ruedas, pesos, levas y engranajes. Su conducta estaba completamente determinada por su diseño. Pero su importancia histórica no está en lo que podían hacer, sino en lo que sugerían. Mostraban que una máquina podía crear la ilusión de autonomía. Podía parecer viva sin estarlo. Podía imitar una acción humana sin comprenderla. En cierto modo, esa tensión sigue presente hoy: una IA puede producir una respuesta inteligente sin pensar como una persona.

También la literatura alimentó este imaginario. Relatos sobre criaturas artificiales, hombres mecánicos o seres creados por la ciencia expresaron tanto fascinación como temor. La pregunta ya no era solo técnica, sino moral: ¿qué ocurre cuando el ser humano fabrica algo que se le parece? ¿Dónde están los límites de la creación artificial? ¿Puede una obra humana escapar al control de su creador? Estas preguntas atraviesan muchas historias modernas y preparan el terreno cultural para entender por qué la inteligencia artificial provoca todavía hoy entusiasmo e inquietud.

Por eso, aunque la IA actual sea hija de los computadores, los datos y las matemáticas, también pertenece a una tradición mucho más antigua. Es la continuación tecnológica de un sueño cultural: crear máquinas que amplíen, imiten o desafíen algunas capacidades humanas. Los autómatas y mitos anteriores a la informática no fueron inteligencia artificial, pero sí fueron su prehistoria imaginaria. Antes de construir máquinas capaces de procesar lenguaje o aprender patrones, el ser humano ya había soñado con ellas. Y ese sueño, entre la admiración y el temor, sigue acompañando cada nuevo avance.

3.2. La modernidad técnica: lógica, cálculo y primeros computadores

El sueño antiguo de crear máquinas capaces de imitar la vida empezó a transformarse de manera decisiva con la modernidad técnica. Durante siglos, los autómatas habían producido asombro porque simulaban movimientos humanos o animales mediante engranajes, resortes y mecanismos visibles. Pero la verdadera posibilidad de una inteligencia artificial no dependía solo de que una máquina pudiera moverse, sino de que pudiera manejar información, seguir reglas, calcular y ejecutar procedimientos. Para llegar ahí fue necesario un cambio profundo: empezar a entender algunas formas del pensamiento como procesos ordenados que podían expresarse mediante lógica y cálculo.

La lógica tuvo un papel fundamental en este camino. Desde la antigüedad se había estudiado el razonamiento correcto, pero en la época moderna y contemporánea la lógica fue adquiriendo una forma cada vez más formal y matemática. La idea era poderosa: si ciertos razonamientos podían reducirse a símbolos, reglas y operaciones, tal vez podrían ser ejecutados por una máquina. Esto no significaba que toda la inteligencia humana pudiera convertirse en cálculo, pero sí que algunas partes del razonamiento podían describirse de manera precisa. La inteligencia artificial nacería más tarde de esa intuición: para que una máquina realice tareas inteligentes, primero hay que traducir parte del pensamiento a un lenguaje operativo.

El cálculo también fue esencial. Las primeras máquinas calculadoras, diseñadas para sumar, restar o realizar operaciones mecánicas, mostraron que una máquina podía encargarse de tareas mentales repetitivas con mayor velocidad y precisión que una persona. Al principio eran dispositivos limitados, pensados para operaciones concretas, pero representaban un cambio enorme. Ya no se trataba solo de máquinas que movían objetos o imitaban gestos, sino de máquinas que trataban con números. El cálculo, que durante siglos había sido una actividad humana, empezaba a convertirse en una función técnica.

Con el tiempo, esta línea de desarrollo condujo a una idea todavía más importante: la máquina programable. La diferencia entre una calculadora mecánica y un computador moderno no está solo en la potencia, sino en la flexibilidad. Un computador no sirve únicamente para una operación cerrada; puede ejecutar instrucciones diferentes según el programa que reciba. Esa posibilidad abrió un territorio nuevo. Si una máquina podía manipular números, símbolos e instrucciones, también podía convertirse en una herramienta para representar procesos más complejos: clasificar información, resolver problemas, simular sistemas o ejecutar reglas lógicas.

Los primeros computadores del siglo XX fueron fruto de muchas necesidades: científicas, militares, administrativas y matemáticas. Se buscaban máquinas capaces de realizar cálculos largos, procesar información y ayudar en tareas que superaban la capacidad humana ordinaria. Eran enormes, costosos y muy limitados en comparación con los dispositivos actuales, pero marcaron un punto de inflexión. Por primera vez existían máquinas electrónicas capaces de procesar datos a gran velocidad y obedecer programas. Aquello convirtió en realidad técnica lo que antes era solo una hipótesis: que ciertas operaciones mentales podían ser delegadas en sistemas artificiales.

Este proceso preparó directamente el nacimiento de la inteligencia artificial. Para crear IA no bastaba con imaginar máquinas inteligentes; hacía falta una base material capaz de ejecutar instrucciones, almacenar información y procesar símbolos. La lógica aportó el lenguaje formal; el cálculo aportó la operación; el computador aportó la arquitectura técnica. La combinación de estos tres elementos permitió empezar a formular una pregunta nueva: si una máquina puede calcular y manipular símbolos, ¿podría también razonar, aprender o conversar?

Esa pregunta no tenía todavía una respuesta clara, pero ya estaba planteada en términos científicos. La modernidad técnica convirtió un viejo sueño en un problema investigable. La inteligencia artificial dejaría de ser una fantasía de autómatas y criaturas mecánicas para convertirse en un campo ligado a las matemáticas, la informática y la teoría de la información. A partir de ese momento, el desafío ya no consistía solo en fabricar una máquina que pareciera viva, sino en construir sistemas capaces de procesar conocimiento. Ahí comenzó el camino que llevaría, poco a poco, desde los primeros computadores hasta las formas actuales de inteligencia artificial.

3.3. Alan Turing y la pregunta por la inteligencia de las máquinas

Alan Turing ocupa un lugar fundamental en la historia de la inteligencia artificial porque ayudó a formular de manera moderna una pregunta que llevaba siglos rondando la imaginación humana: ¿puede una máquina pensar? Antes de Turing, ya existían autómatas, máquinas de cálculo, mecanismos complejos y primeros computadores. Pero con él la cuestión cambió de nivel. Ya no se trataba solo de construir artefactos capaces de moverse o calcular, sino de preguntarse si una máquina podía comportarse de un modo que asociamos a la inteligencia.

Turing fue matemático, lógico y uno de los grandes nombres de la informática del siglo XX. Su importancia no se limita a la inteligencia artificial, porque también fue decisivo en la teoría de la computación y en el desarrollo de los primeros computadores. Su trabajo permitió pensar de forma rigurosa qué podía hacer una máquina siguiendo reglas. Esta idea fue esencial: si una tarea podía expresarse mediante un procedimiento claro, una máquina podía ejecutarla. De ahí nació una parte importante del pensamiento informático moderno.

La pregunta por la inteligencia de las máquinas se hizo especialmente famosa a través de su propuesta del llamado “test de Turing”. Turing evitó discutir directamente si una máquina “piensa” en el mismo sentido que una persona, porque esa palabra es difícil de definir. En lugar de plantear la cuestión de forma abstracta, propuso observar el comportamiento. Si una máquina puede mantener una conversación por escrito y sus respuestas resultan indistinguibles de las de un ser humano para un interlocutor, entonces podríamos decir que muestra una forma de inteligencia funcional. No se trata de demostrar que tenga conciencia, sino de valorar si puede actuar lingüísticamente como si fuera inteligente.

Esta propuesta fue muy influyente porque desplazó el debate desde el interior de la máquina hacia su conducta observable. Turing no resolvía todos los problemas filosóficos, pero ofrecía una manera práctica de pensar la cuestión. La inteligencia, al menos en parte, podía evaluarse por la capacidad de responder, adaptarse, razonar en apariencia y participar en un intercambio significativo. Esta idea anticipa de forma sorprendente muchos debates actuales, especialmente en una época en la que los sistemas conversacionales pueden producir textos coherentes, responder preguntas y mantener diálogos complejos.

Sin embargo, el test de Turing también plantea límites. Que una máquina logre imitar una conversación humana no significa necesariamente que comprenda como una persona. Puede simular inteligencia sin tener experiencia, intención, emociones o conciencia. Esta distinción es muy importante hoy, porque los sistemas actuales pueden generar respuestas muy convincentes. La pregunta de Turing sigue viva precisamente porque nos obliga a distinguir entre parecer inteligente y ser inteligente en sentido humano. La máquina puede actuar de forma inteligente en una tarea concreta, pero eso no implica que posea una mente como la nuestra.

La figura de Turing es también importante porque une ciencia, lógica y una profunda intuición cultural. Comprendió que los computadores no eran simples calculadoras rápidas, sino máquinas generales capaces de ejecutar múltiples procedimientos. Esa visión abrió la puerta a imaginar sistemas que no solo calcularan números, sino que manipularan símbolos, lenguaje e información. La inteligencia artificial nace de esa posibilidad: convertir aspectos del razonamiento, la percepción o la comunicación en procesos que una máquina pueda ejecutar.

Mirado desde el presente, Turing aparece como uno de los grandes anticipadores de nuestro mundo digital. Muchas de las preguntas que hoy nos hacemos sobre la inteligencia artificial ya estaban contenidas en su reflexión: qué significa que una máquina responda, qué valor tiene la imitación, dónde acaba el cálculo y dónde empieza la inteligencia, cómo distinguir comportamiento inteligente y comprensión real. Su mérito no fue ofrecer una respuesta definitiva, sino formular la pregunta de una manera tan potente que todavía seguimos pensando dentro de su marco.

Por eso Alan Turing es una figura clave en este recorrido. Con él, el viejo sueño de los autómatas y las máquinas inteligentes dejó de pertenecer solo al terreno de la fantasía y empezó a convertirse en un problema científico. La inteligencia artificial moderna no puede entenderse sin esa pregunta inicial, sencilla y enorme al mismo tiempo: si una máquina puede manejar símbolos, conversar y responder de forma convincente, ¿hasta dónde puede acercarse a lo que llamamos inteligencia?

3.4. El nacimiento formal de la inteligencia artificial en el siglo XX

El nacimiento formal de la inteligencia artificial se produjo en el siglo XX, cuando una antigua aspiración humana empezó a convertirse en un campo científico organizado. Hasta entonces habían existido mitos, autómatas, máquinas de cálculo, reflexiones filosóficas y primeros computadores, pero faltaba algo decisivo: formular la inteligencia artificial como un programa de investigación propio. Es decir, dejar de preguntarse de manera general si una máquina podía imitar al ser humano y empezar a estudiar, con métodos concretos, cómo construir sistemas capaces de razonar, aprender, resolver problemas o manipular información.

Ese paso fue posible gracias al desarrollo de los computadores modernos. Las máquinas electrónicas de mediados del siglo XX demostraron que era posible procesar datos, ejecutar instrucciones y trabajar con símbolos de forma rápida y flexible. Esto abrió una posibilidad nueva: si el pensamiento humano podía describirse parcialmente mediante reglas, operaciones lógicas o procesos de búsqueda, quizá una máquina podría reproducir algunas de esas tareas. La inteligencia artificial nació, por tanto, en la intersección entre la informática, la lógica, las matemáticas, la psicología cognitiva y la ambición de comprender mejor la inteligencia humana.

Uno de los momentos simbólicos más importantes fue la conferencia celebrada en Dartmouth, en 1956, organizada por investigadores como John McCarthy, Marvin Minsky, Nathaniel Rochester y Claude Shannon. Allí se utilizó y consolidó la expresión “inteligencia artificial” para referirse a este nuevo campo. La idea de fondo era audaz: estudiar si todos los aspectos del aprendizaje o de la inteligencia podían describirse con suficiente precisión como para que una máquina pudiera simularlos. Aquella formulación resultaba optimista, incluso excesiva, pero tuvo una enorme fuerza fundacional. Por primera vez, la inteligencia artificial aparecía como una disciplina con nombre, objetivos y comunidad investigadora.

Los primeros investigadores de IA trabajaron sobre problemas que parecían representar capacidades inteligentes: jugar al ajedrez, demostrar teoremas, resolver rompecabezas, traducir lenguajes, planificar acciones o mantener formas básicas de conversación. Muchos de estos proyectos partían de una confianza muy grande en el poder de las reglas y los símbolos. Si un problema podía dividirse en pasos, representarse de manera lógica y resolverse mediante búsqueda, entonces parecía posible automatizarlo. Esta fue la base de la llamada inteligencia artificial simbólica, dominante en las primeras décadas.

El entusiasmo inicial fue enorme. Algunos investigadores pensaban que en pocas décadas podrían construirse máquinas capaces de realizar muchas tareas intelectuales humanas. Esa confianza se explica por el impacto de los primeros éxitos: programas capaces de resolver problemas matemáticos o jugar a ciertos juegos daban la impresión de que el camino hacia una inteligencia artificial general estaba abierto. Sin embargo, pronto aparecieron dificultades mucho más profundas. Las máquinas podían funcionar bien en entornos cerrados y definidos, pero tenían muchos problemas para manejar la ambigüedad, el sentido común, el lenguaje natural, la percepción y la complejidad del mundo real.

Aun así, el nacimiento formal de la inteligencia artificial fue un acontecimiento decisivo. Aunque sus primeras expectativas fueran demasiado optimistas, estableció las preguntas básicas que todavía siguen vivas: qué es razonar, cómo se representa el conocimiento, cómo aprende una máquina, cómo se resuelven problemas, cómo se comprende el lenguaje y qué diferencia hay entre simular inteligencia y poseer inteligencia humana. La IA nació como tecnología, pero también como investigación sobre nosotros mismos, porque al intentar reproducir la inteligencia hubo que preguntarse qué significa realmente ser inteligente.

Desde ese momento, la inteligencia artificial avanzó de manera irregular, con épocas de entusiasmo y etapas de decepción. Pero el campo ya estaba creado. Lo que había sido un sueño antiguo y una pregunta filosófica se convirtió en una disciplina científica. Esa transición marca el verdadero comienzo de la IA moderna: el momento en que la imaginación sobre máquinas inteligentes empezó a traducirse en programas, laboratorios, algoritmos, teorías y experimentos. El siglo XX dio así forma técnica a una idea que la humanidad llevaba siglos imaginando.

4. Primera etapa: la inteligencia artificial simbólica

4.1. Sistemas basados en reglas, símbolos y razonamiento lógico.

4.2. La idea de programar el conocimiento humano.

4.3. Los sistemas expertos y la promesa de automatizar decisiones complejas.

4.4. Límites de la IA simbólica: rigidez, falta de contexto y dificultad para aprender.

La primera gran etapa de la inteligencia artificial estuvo marcada por una idea muy clara: si la inteligencia humana razona mediante conceptos, reglas y relaciones lógicas, quizá una máquina podría imitarla manipulando símbolos. Esta forma inicial de IA, conocida como inteligencia artificial simbólica, partía de una visión bastante ordenada del pensamiento. Se suponía que muchos problemas podían resolverse si se representaban adecuadamente los datos, se establecían reglas precisas y se aplicaban procedimientos lógicos para llegar a una conclusión.

En esta etapa, la inteligencia se entendía sobre todo como razonamiento explícito. La máquina no “aprendía” a partir de millones de ejemplos, como ocurre en muchos sistemas actuales, sino que seguía reglas diseñadas por seres humanos. Un programa podía recibir información, compararla con una base de conocimiento y aplicar instrucciones del tipo: si ocurre esto, entonces debe concluirse aquello. Este enfoque tenía una gran fuerza conceptual, porque permitía construir sistemas relativamente comprensibles. Se podía ver qué regla se aplicaba, qué dato se usaba y cómo se alcanzaba una respuesta.