La informática es una de las grandes formas contemporáneas de ordenar el mundo. Durante siglos, el ser humano ha creado herramientas para extender la fuerza de sus manos, la velocidad de sus desplazamientos o la precisión de sus sentidos. La rueda, el molino, la imprenta, el telescopio, la máquina de vapor o la electricidad ampliaron capacidades concretas del cuerpo y de la sociedad. Pero la informática introdujo un cambio distinto: no actúa solo sobre la materia o la energía, sino sobre la información. Su terreno propio no es únicamente el hierro, el cable, la pantalla o el circuito, sino los datos, los símbolos, las instrucciones, las relaciones lógicas y las formas de representación que permiten convertir la realidad en algo calculable, almacenable y transmisible.

Por eso la informática no debe entenderse solo como el uso de ordenadores. Esa es quizá su imagen más visible, pero también la más limitada. Un ordenador, un teléfono móvil, una red social, un cajero automático, una base de datos médica, un sistema de navegación, una cámara digital o un programa de diseño son manifestaciones distintas de una misma lógica profunda: la capacidad de transformar información mediante procedimientos automáticos. Allí donde hay datos que se organizan, procesos que se ejecutan, señales que se codifican, archivos que se guardan o comunicaciones que se transmiten, aparece alguna forma de pensamiento informático. La informática está en la superficie de la vida moderna, pero también en su estructura oculta.

Su importancia procede precisamente de esa doble condición. Por un lado, es una disciplina técnica, apoyada en la matemática, la lógica, la electrónica, la ingeniería y el diseño de sistemas. Por otro lado, es una disciplina cultural, porque modifica la forma en que trabajamos, aprendemos, escribimos, compramos, investigamos, nos comunicamos y conservamos la memoria. Una biblioteca digital, un archivo fotográfico, una página web, una historia clínica informatizada o un mapa interactivo no son simples versiones modernas de objetos antiguos: son nuevas formas de ordenar la experiencia humana. La información ya no solo se escribe o se conserva; se busca, se filtra, se relaciona, se copia, se comparte y se actualiza de manera continua.

En este sentido, la informática puede verse como una nueva capa de la civilización. Igual que las ciudades antiguas necesitaron caminos, puentes, almacenes, normas y sistemas de escritura para funcionar, las sociedades actuales necesitan redes, servidores, programas, bases de datos, protocolos y dispositivos conectados. Buena parte de nuestra vida cotidiana descansa sobre estructuras que no vemos. Encendemos el móvil, consultamos una cuenta bancaria, enviamos un mensaje, guardamos una fotografía, abrimos una página web o usamos un navegador, y todo parece inmediato. Sin embargo, detrás de ese gesto sencillo hay lenguajes de programación, sistemas operativos, centros de datos, cables submarinos, algoritmos, medidas de seguridad, interfaces visuales y millones de decisiones técnicas acumuladas.

Este tema pretende introducir la informática desde esa mirada amplia. No se trata solo de explicar qué es un ordenador, qué partes tiene o cómo funciona un programa, aunque esos aspectos sean necesarios. Se trata de comprender por qué la informática se ha convertido en una infraestructura básica de nuestro tiempo. Sus efectos alcanzan la ciencia, la empresa, la administración, la educación, el arte, la medicina, la economía, la comunicación y la vida doméstica. Hoy se investiga con ordenadores, se diseña con programas, se diagnostica con sistemas digitales, se enseña con plataformas, se compra a través de redes, se trabaja con documentos compartidos y se conserva una parte creciente de la cultura en soportes electrónicos. La informática no es un sector aislado: atraviesa casi todos los demás.

También conviene acercarse a ella sin fascinación ingenua ni rechazo automático. La tecnología digital ha abierto posibilidades extraordinarias, pero también ha creado nuevas dependencias. Ha multiplicado la capacidad de acceso al conocimiento, pero ha favorecido la dispersión y la saturación informativa. Ha facilitado la comunicación, pero también la vigilancia, la manipulación y el uso intensivo de datos personales. Ha mejorado muchos procesos de trabajo, pero ha transformado profesiones, hábitos y formas de atención. La informática no es buena ni mala por sí misma: es una fuerza técnica que depende del uso humano, de las instituciones que la regulan, de los intereses económicos que la impulsan y del criterio con que cada persona la incorpora a su vida.

Por eso resulta importante comprender sus fundamentos. No hace falta ser programador, ingeniero o especialista en redes para tener una cultura informática básica. Del mismo modo que una persona culta puede saber algo de historia, biología, economía o derecho sin dedicarse profesionalmente a esas disciplinas, también puede y debe entender los conceptos esenciales del mundo digital. Saber qué es la información, cómo se procesa, qué diferencia hay entre software y hardware, qué función cumplen las redes, qué significa almacenar datos en la nube, por qué importa la ciberseguridad o qué papel desempeña la inteligencia artificial permite vivir con más conciencia en una sociedad profundamente informatizada.

La informática, además, tiene una dimensión intelectual muy hermosa: convierte el pensamiento en procedimiento. Un algoritmo no es magia, sino una secuencia ordenada de pasos para resolver un problema. Un programa no es una entidad misteriosa, sino un conjunto de instrucciones escritas en un lenguaje que una máquina puede ejecutar. Una base de datos no es solo un almacén frío de registros, sino una forma de clasificar la realidad para poder encontrarla, relacionarla y comprenderla. Incluso los sistemas más avanzados, como la inteligencia artificial, descansan sobre esa idea básica: representar información, procesarla y obtener resultados útiles. Detrás del brillo de las pantallas hay una disciplina de orden, precisión y estructura.

A lo largo de este tema, la informática aparecerá como ciencia, como técnica y como fenómeno social. Será necesario hablar de ordenadores y programas, pero también de redes, datos, servidores, ciberseguridad, imagen digital, robótica, educación, cultura, economía, ética y futuro tecnológico. La intención no es construir un manual técnico, sino una introducción comprensible y sólida a una de las disciplinas que más han transformado la vida contemporánea. Comprender la informática es comprender una parte esencial del presente: la manera en que la humanidad ha aprendido a convertir la información en herramienta, en memoria, en comunicación, en conocimiento y también en poder.

En última instancia, la informática nos obliga a mirar de otro modo lo cotidiano. Cada archivo guardado, cada imagen editada, cada búsqueda realizada, cada mensaje enviado y cada dispositivo conectado forman parte de una red inmensa de operaciones invisibles. Vivimos rodeados de sistemas que procesan información de manera continua, hasta el punto de que muchas veces solo reparamos en ellos cuando fallan. Este trabajo busca precisamente detenerse ahí, en aquello que parece normal porque ya forma parte de la rutina. La informática es el lenguaje técnico de una época que ha hecho de los datos una materia fundamental. Entenderla no significa rendirse ante la tecnología, sino recuperar una relación más lúcida, más crítica y más humana con el mundo digital que hemos construido.

«Informática: origen, fundamentos y funcionamiento de los sistemas digitales».

1. Introducción general: la informática como ciencia del tratamiento de la información

1.1. Qué entendemos por informática

1.2. La información como materia prima del mundo digital

1.3. La informática entre la matemática, la lógica, la ingeniería y la comunicación

1.4. Por qué la informática es una de las grandes disciplinas de la Edad Contemporánea

1.5. Diferencia entre informática, computación, tecnología digital e Internet

La informática es una de esas disciplinas que han cambiado el mundo sin que siempre seamos conscientes de su profundidad. A menudo la asociamos de forma inmediata con ordenadores, teléfonos móviles, programas, redes sociales o Internet, pero su sentido es más amplio. La informática no se limita al uso de máquinas digitales: estudia cómo se representa, organiza, procesa, almacena y transmite la información mediante sistemas automáticos. Su centro no es solo el aparato, sino la información misma. Por eso puede entenderse como una ciencia técnica del tratamiento de la información, una disciplina situada entre el pensamiento lógico, la matemática, la ingeniería y la comunicación humana.

Este primer capítulo sirve como entrada general al tema. Antes de hablar de ordenadores, redes, programas, servidores o inteligencia artificial, conviene detenerse en la idea básica que sostiene todo el edificio: la información. Vivimos rodeados de datos, mensajes, imágenes, números, textos, sonidos, señales y registros. Cada fotografía guardada en un teléfono, cada página web, cada archivo, cada pago electrónico, cada búsqueda en Internet y cada mensaje enviado por una aplicación son formas de información codificada. La informática permite que esa información pueda transformarse en algo manejable por las máquinas. Lo que para nosotros aparece como una imagen, una canción o una conversación, para el sistema digital se convierte en una estructura organizada de datos que puede ser leída, modificada, copiada, transmitida y recuperada.

Entender qué es la informática exige, por tanto, mirar más allá del uso cotidiano de los dispositivos. Un ordenador no es simplemente una pantalla con teclado, ni un teléfono móvil es solo un objeto de comunicación personal. Ambos son sistemas capaces de recibir datos, procesarlos siguiendo instrucciones y ofrecer resultados. Esta lógica básica está presente en tareas muy sencillas, como abrir un documento o calcular una operación, y también en procesos complejos, como predecir el tiempo, analizar el ADN, gestionar una red eléctrica, organizar el tráfico de una ciudad o entrenar modelos de inteligencia artificial. La informática se ha convertido así en una herramienta transversal, capaz de entrar en casi todas las áreas de la vida moderna.

El capítulo también permite situar la informática dentro de un conjunto amplio de saberes. Tiene una base matemática, porque necesita estructuras formales, cálculo, algoritmos y modelos lógicos. Tiene una dimensión de ingeniería, porque esos principios deben materializarse en máquinas, circuitos, redes y programas que funcionen de manera fiable. Tiene una parte comunicativa, porque la información solo adquiere sentido cuando puede ser emitida, interpretada y compartida. Y tiene, además, una dimensión social, porque los sistemas informáticos no se quedan encerrados en los laboratorios: organizan empresas, administraciones, hospitales, bancos, medios de comunicación, archivos culturales y relaciones personales.

Por eso la informática puede considerarse una de las grandes disciplinas de la Edad Contemporánea. Si la Revolución Industrial transformó la producción mediante máquinas movidas por energía física, la revolución informática ha transformado la organización del mundo mediante máquinas capaces de trabajar con información. No sustituye solo fuerza muscular, como ocurrió con muchas tecnologías anteriores; también amplía la memoria, el cálculo, la coordinación, la comunicación y la toma de decisiones. Su impacto no se reduce a la técnica: afecta a la economía, al conocimiento, a la educación, al trabajo, a la cultura y a la forma misma en que percibimos la realidad.

Este primer bloque también debe aclarar algunas confusiones frecuentes. Informática, computación, tecnología digital e Internet no son exactamente lo mismo, aunque estén muy relacionadas. La informática es el campo general que estudia y desarrolla el tratamiento automático de la información. La computación se centra especialmente en el cálculo, los algoritmos y los procesos que ejecutan las máquinas. La tecnología digital es el conjunto de dispositivos, sistemas y medios que utilizan datos codificados digitalmente. Internet, por su parte, es una gran red mundial que permite conectar sistemas y transmitir información entre ellos. Dicho de forma sencilla: Internet es una de las grandes aplicaciones de la informática, pero no agota todo lo que la informática es.

Este capítulo introductorio, por tanto, prepara el terreno para comprender mejor el resto del artículo. Su finalidad no es entrar todavía en detalles técnicos, sino ofrecer una visión clara de conjunto: la informática nace del deseo de ordenar y procesar información, se apoya en la lógica y en la matemática, se materializa en máquinas y programas, y ha terminado convirtiéndose en una infraestructura básica de la vida actual. Comprenderla no significa convertirse en especialista, sino aprender a mirar con más claridad el mundo digital en el que ya vivimos.

1.1. Qué entendemos por informática

La informática es la disciplina que estudia el tratamiento automático de la información mediante sistemas capaces de recibir datos, procesarlos, almacenarlos y producir resultados útiles. Aunque en el lenguaje cotidiano solemos asociarla con ordenadores, móviles, programas o Internet, su sentido profundo es más amplio. La informática no se ocupa solo de las máquinas, sino de la relación entre la información y los procedimientos que permiten transformarla. Allí donde una serie de datos se organiza, se codifica, se calcula, se guarda o se comunica mediante medios automáticos, aparece una forma de actividad informática.

Para entenderlo de manera sencilla, puede decirse que la informática trabaja con información igual que otras técnicas trabajan con materiales físicos. Un carpintero transforma madera; un electricista canaliza energía; un sistema informático transforma datos. La diferencia está en que su materia prima no es visible de la misma forma. Un texto, una imagen, una canción, una temperatura medida por un sensor, una cuenta bancaria o una página web pueden convertirse en datos digitales. Una vez convertidos, el sistema puede ordenarlos, modificarlos, copiarlos, compararlos, buscarlos o enviarlos a distancia. La informática hace posible que la información deje de ser algo fijo y pase a convertirse en un recurso dinámico.

Esta idea es fundamental porque evita reducir la informática al simple uso de aparatos. Saber manejar un ordenador no es lo mismo que comprender qué es la informática. El usuario abre una aplicación, escribe un documento, consulta una web o guarda una fotografía; pero detrás de esos gestos hay programas, instrucciones, memoria, procesadores, lenguajes, archivos y reglas de funcionamiento. La informática estudia precisamente ese mundo oculto que permite que la acción visible tenga lugar. Su objetivo no es solo construir máquinas, sino diseñar sistemas capaces de resolver problemas mediante el procesamiento organizado de información.

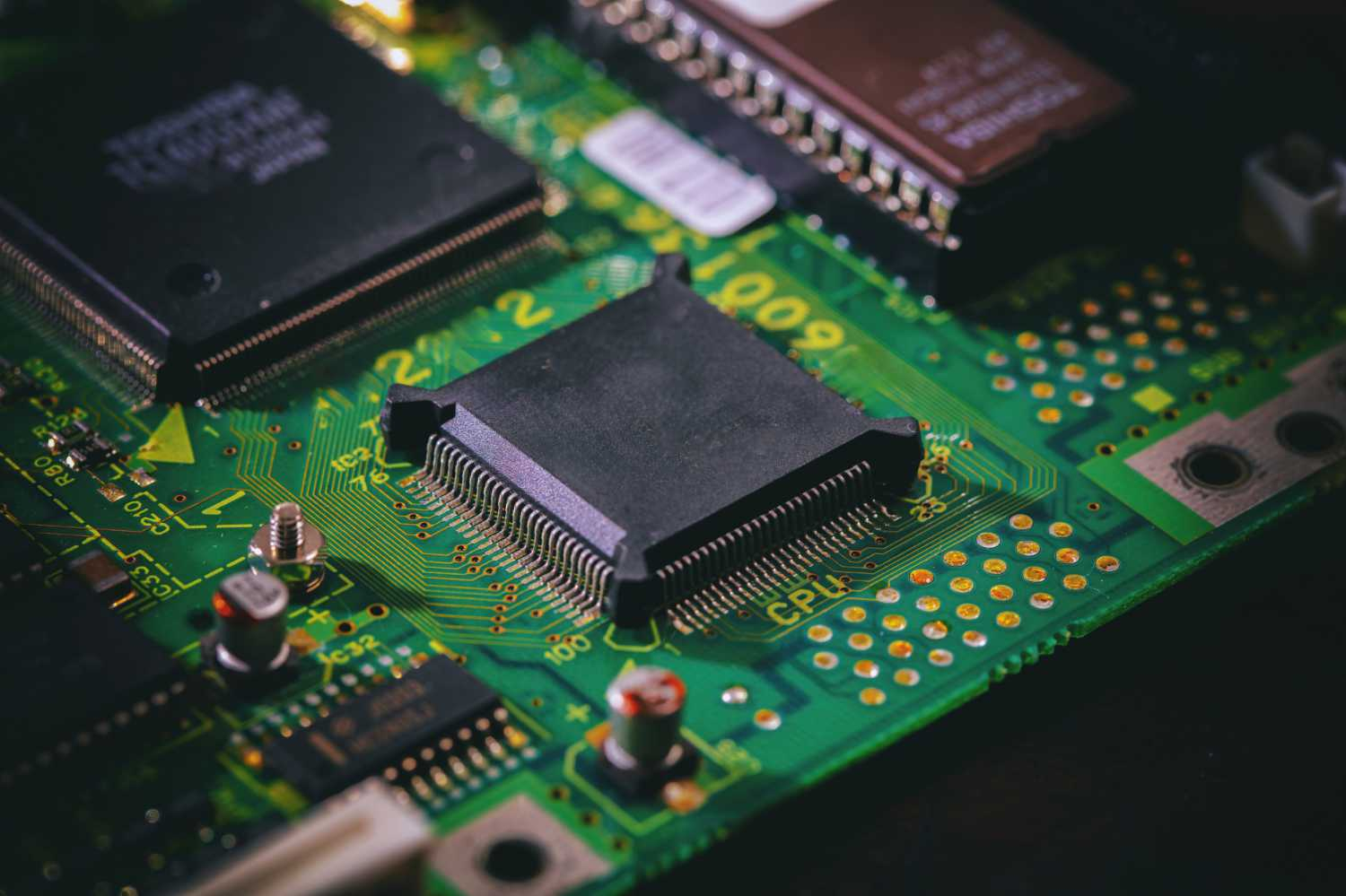

Por eso la informática une varias dimensiones. Tiene una base lógica, porque necesita ordenar los pasos de un proceso con claridad. Tiene una base matemática, porque muchos de sus métodos se apoyan en el cálculo, la estructura y la representación formal. Tiene una dimensión técnica, porque esas ideas deben realizarse en componentes físicos: circuitos, procesadores, memorias, cables, pantallas y dispositivos. Y tiene una dimensión práctica, porque todo ese conjunto se orienta a tareas concretas: escribir, calcular, diseñar, comunicarse, investigar, administrar, crear imágenes, analizar datos o controlar máquinas.

Un ejemplo cotidiano puede ayudar a verlo. Cuando una persona busca una palabra en un documento, el ordenador no “entiende” el texto como lo entiende un ser humano. Lo que hace es comparar símbolos codificados, recorrer datos almacenados y aplicar instrucciones para localizar coincidencias. El resultado parece simple, casi instantáneo, pero se apoya en una cadena de operaciones muy precisa. Lo mismo ocurre al enviar un mensaje, reproducir una canción o abrir una fotografía. La experiencia humana es directa; el funcionamiento interno es una sucesión de procesos informáticos.

Entender la informática, por tanto, significa comprender cómo la información puede convertirse en algo operable por una máquina. Esa capacidad ha cambiado de forma profunda la vida contemporánea. Antes, muchas tareas dependían de registros manuales, cálculos lentos, archivos físicos o comunicaciones limitadas. Hoy, enormes cantidades de información pueden circular, organizarse y transformarse en segundos. La informática ha ampliado la memoria colectiva, la capacidad de cálculo, la comunicación y la gestión de la sociedad moderna.

En su sentido más amplio, la informática es una forma de mediación entre el pensamiento humano y la máquina. El ser humano define problemas, crea lenguajes, diseña procedimientos y establece objetivos; el sistema informático ejecuta operaciones a gran velocidad y con gran precisión. Esa colaboración ha dado lugar a una de las herramientas más poderosas de nuestro tiempo. Comprender qué es la informática no consiste solo en saber usar tecnología, sino en reconocer la lógica que hay detrás de ella: el arte técnico de convertir información en acción, conocimiento y organización.

1.2. La información como materia prima del mundo digital

La información es la materia prima de la informática. Todo sistema digital, por avanzado que parezca, trabaja en último término con datos: números, textos, imágenes, sonidos, señales, coordenadas, registros, instrucciones o medidas tomadas del mundo real. Lo que para una persona puede ser una fotografía, una canción, una factura, un mensaje o una noticia, para una máquina es información codificada de una manera precisa. La informática no crea el mundo, pero sí lo traduce a formas que pueden ser almacenadas, procesadas y transmitidas por sistemas automáticos.

Esta idea permite comprender mejor la diferencia entre el mundo físico y el mundo digital. En la vida cotidiana, un objeto existe como algo material: una carta escrita en papel, un disco de música, una fotografía impresa, un mapa, una agenda o un libro. En el entorno digital, esos mismos contenidos pueden convertirse en datos. Una carta pasa a ser un documento electrónico; una canción, un archivo de audio; una imagen, una matriz de píxeles; un mapa, una estructura de coordenadas; una agenda, una base de datos organizada. La información deja de depender de un único soporte físico y puede copiarse, modificarse, enviarse o consultarse desde distintos lugares.

Esta transformación tiene una importancia enorme. Cuando la información se digitaliza, se vuelve mucho más flexible. Puede viajar a gran velocidad, almacenarse en espacios muy reducidos, combinarse con otros datos y recuperarse mediante búsquedas. Antes, encontrar un documento podía exigir revisar carpetas, archivos o estanterías. Hoy, un sistema informático puede localizar una palabra, una fecha o una imagen en cuestión de segundos. Esa capacidad no es magia: depende de que la información haya sido organizada de forma que la máquina pueda manejarla.

Por eso el mundo digital está construido sobre procesos de representación. Un ordenador no ve una fotografía como la ve una persona, ni escucha una canción como la escucha un oído humano. La imagen se convierte en puntos de color; el sonido, en valores numéricos; el texto, en códigos asociados a caracteres; el movimiento, en secuencias de datos. La riqueza de la experiencia humana se reduce, dentro de la máquina, a estructuras ordenadas que pueden ser tratadas de manera automática. Esa reducción no elimina el significado para nosotros, pero permite que el sistema trabaje con él técnicamente.

La información digital también tiene una característica decisiva: puede multiplicarse sin perderse en el acto de copia. Una herramienta física, si se presta, deja de estar momentáneamente en manos de quien la tenía. Un archivo digital, en cambio, puede reproducirse muchas veces y mantenerse disponible para distintos usuarios. Esta cualidad ha cambiado la cultura, la educación, la comunicación y la economía. Libros, imágenes, vídeos, datos científicos, documentos administrativos y contenidos personales circulan hoy con una facilidad desconocida en otras épocas.

Sin embargo, esa abundancia también plantea problemas. Si la información es la materia prima del mundo digital, su calidad, su orden y su fiabilidad resultan fundamentales. No todos los datos son útiles, no toda información es verdadera y no todo contenido abundante produce conocimiento. Una base de datos mal organizada, una noticia falsa, un archivo corrupto o una información sacada de contexto pueden generar confusión, errores o decisiones equivocadas. La informática permite procesar información, pero no garantiza por sí sola que esa información sea correcta, justa o significativa.

De ahí que comprender la informática implique también comprender el valor de los datos. Los sistemas digitales funcionan porque reciben información, pero el sentido final de esa información depende de los seres humanos que la producen, la interpretan y la utilizan. Un hospital necesita datos fiables para diagnosticar; una empresa necesita registros correctos para gestionar; una biblioteca digital necesita orden para ser útil; una persona necesita criterio para distinguir entre información valiosa y ruido. El mundo digital se apoya en datos, pero la inteligencia humana sigue siendo necesaria para darles sentido.

La información es, por tanto, el material invisible con el que trabaja la informática. No pesa como una piedra ni ocupa espacio como una máquina tradicional, pero organiza buena parte de la vida contemporánea. Cada mensaje enviado, cada imagen guardada, cada compra registrada, cada búsqueda realizada y cada documento compartido forman parte de ese flujo continuo. Entender la informática empieza por reconocer esta realidad sencilla y profunda: vivimos en una época en la que la información se ha convertido en una materia activa, capaz de circular, transformarse y sostener una parte esencial de nuestra organización social.

1.3. La informática entre la matemática, la lógica, la ingeniería y la comunicación

La informática no nace de una sola disciplina, sino del encuentro entre varias formas de conocimiento. Para comprenderla bien conviene verla como un territorio compartido entre la matemática, la lógica, la ingeniería y la comunicación. Cada una de estas áreas aporta algo esencial. La matemática le da estructura y capacidad de cálculo; la lógica le aporta orden y coherencia en los procedimientos; la ingeniería convierte las ideas en máquinas, redes y sistemas reales; y la comunicación permite que la información pueda representarse, transmitirse e interpretarse. La informática es precisamente esa unión: pensamiento formal convertido en herramienta práctica para trabajar con información.

Su relación con la matemática es muy profunda. Los ordenadores no funcionan por intuición, sino mediante operaciones definidas con precisión. Detrás de una búsqueda, una imagen digital, un videojuego, un programa de contabilidad o un sistema de inteligencia artificial hay estructuras numéricas, reglas de cálculo, modelos y formas de representación. Esto no significa que todo usuario deba dominar matemáticas avanzadas, pero sí ayuda a entender que el mundo digital se apoya en una base cuantificable. La máquina necesita convertir la realidad en datos manejables: números, coordenadas, códigos, valores y relaciones.

La lógica es igualmente decisiva. Un sistema informático debe saber qué hacer en cada situación según unas reglas previamente establecidas. Si ocurre una cosa, ejecuta una acción; si no ocurre, sigue otro camino. Esta forma de organizar decisiones es la base de los algoritmos y de la programación. La lógica permite ordenar procesos complejos en pasos claros. Sin ella, la máquina no podría trabajar de forma fiable. Un programa, en el fondo, es una cadena de instrucciones organizadas con coherencia. Puede ser muy sencillo o extremadamente complejo, pero siempre necesita una estructura interna que evite el caos.

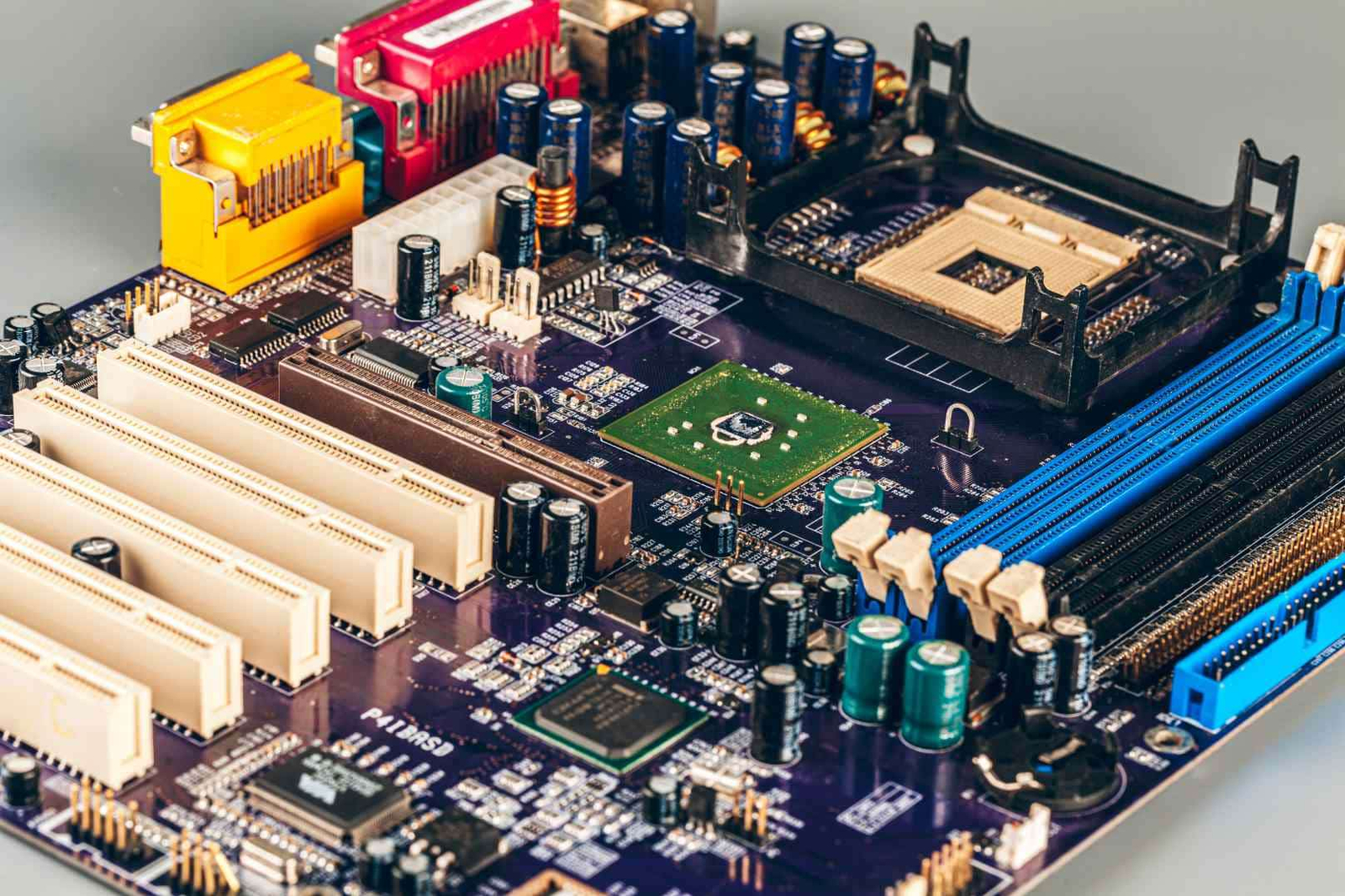

La ingeniería aporta la dimensión material. Las ideas matemáticas y lógicas necesitan encarnarse en dispositivos concretos: procesadores, memorias, circuitos, pantallas, servidores, cables, sensores y redes. La informática no es solo teoría; también es construcción técnica. Un ordenador debe funcionar, resistir errores, almacenar datos, comunicarse con otros sistemas y responder al usuario. Lo mismo ocurre con un teléfono móvil, un centro de datos, un sistema bancario o una plataforma digital. La ingeniería convierte el pensamiento abstracto en infraestructura útil.

Pero la informática también está ligada a la comunicación. La información no vale solo por existir, sino porque puede ser compartida, comprendida y usada. Los sistemas digitales codifican mensajes, organizan archivos, transmiten señales y crean interfaces para que las personas puedan interactuar con las máquinas. Un correo electrónico, una página web, una videollamada o una red social son ejemplos claros de esta dimensión comunicativa. En todos ellos, la informática actúa como puente entre emisores, receptores, lenguajes y soportes técnicos.

Esta mezcla explica por qué la informática es tan poderosa. No se limita a calcular, ni solo a fabricar máquinas, ni solo a enviar mensajes. Reúne cálculo, orden, técnica y comunicación en un mismo sistema. Por eso puede utilizarse en campos tan distintos como la medicina, la educación, la astronomía, la administración, el diseño gráfico, la economía o la cultura. Allí donde hay información que organizar y procesos que automatizar, la informática encuentra un espacio de aplicación.

También por eso puede parecer una disciplina difícil de delimitar. A veces se presenta como ciencia, otras como tecnología, otras como herramienta profesional y otras como entorno cultural. En realidad, es todo eso a la vez. Tiene fundamentos teóricos, necesita soluciones técnicas, produce aplicaciones prácticas y transforma la manera en que las personas se comunican y organizan su vida. Esa amplitud no es una debilidad, sino una de sus grandes fortalezas.

Entender la informática desde esta perspectiva evita verla como simple manejo de aparatos. Un sistema informático es el resultado de muchas capas unidas: ideas matemáticas, reglas lógicas, componentes físicos y formas de comunicación humana. Cada vez que usamos un dispositivo digital, esas capas trabajan juntas aunque no las veamos. La informática es, por tanto, una disciplina de conexión: une el cálculo con la palabra, la máquina con el usuario, el dato con el significado y la abstracción con la vida cotidiana.

1.4. Por qué la informática es una de las grandes disciplinas de la Edad Contemporánea

La informática es una de las grandes disciplinas de la Edad Contemporánea porque ha cambiado la forma en que las sociedades producen, organizan, comunican y conservan la información. Su importancia no se debe solo a que haya creado ordenadores más rápidos o dispositivos más pequeños, sino a que ha introducido una nueva manera de trabajar con la realidad. Allí donde antes había archivos en papel, cálculos manuales, comunicaciones lentas o procesos aislados, hoy existen sistemas digitales capaces de registrar, procesar, conectar y distribuir datos a una velocidad desconocida en épocas anteriores.

Cada gran etapa histórica ha tenido tecnologías que han transformado la vida humana. La agricultura permitió asentamientos estables; la escritura hizo posible administrar, recordar y transmitir conocimiento; la imprenta multiplicó la difusión de los textos; la máquina de vapor impulsó la industria; la electricidad reorganizó la producción, la comunicación y la vida urbana. La informática se sitúa en esa misma línea de grandes transformaciones, pero con una particularidad: no trabaja principalmente con fuerza física, sino con información. Su poder consiste en ampliar la memoria, el cálculo, la coordinación y la comunicación de las sociedades.

Por eso su influencia alcanza casi todos los ámbitos. En la economía, permite gestionar empresas, automatizar procesos, controlar inventarios, realizar pagos electrónicos y analizar mercados. En la ciencia, ayuda a simular fenómenos, procesar datos experimentales, estudiar el clima, analizar genomas o explorar el universo. En la medicina, interviene en historiales clínicos, diagnóstico por imagen, investigación biomédica y organización hospitalaria. En la cultura, ha transformado la fotografía, el diseño, la música, el cine, la edición, los archivos y la difusión del conocimiento. En la vida cotidiana, aparece en el móvil, el correo electrónico, las plataformas digitales, los navegadores, los mapas, los sistemas de mensajería y los servicios en la nube.

Su relevancia también procede de su carácter transversal. La informática no es una disciplina encerrada en sí misma, sino una herramienta que se incorpora a otras actividades y las modifica desde dentro. Un banco, una universidad, una biblioteca, una fábrica, un museo, un hospital o una administración pública ya no funcionan igual después de la digitalización. Sus tareas no solo se hacen más rápido; muchas veces cambian de naturaleza. Lo que antes era un archivo físico se convierte en una base de datos; lo que antes era una gestión presencial se convierte en un trámite electrónico; lo que antes era una comunicación local puede convertirse en una interacción global.

Además, la informática ha cambiado la relación entre las personas y el conocimiento. Nunca ha sido tan fácil acceder a información, consultar documentos, comparar fuentes, aprender a distancia o publicar contenidos propios. Esto ha abierto posibilidades enormes, pero también exige más criterio. La abundancia de información no garantiza comprensión. Precisamente por eso la informática no debe verse solo como una comodidad técnica, sino como una disciplina que obliga a pensar cómo usamos los datos, cómo distinguimos lo valioso de lo superficial y cómo mantenemos la autonomía humana dentro de sistemas cada vez más automatizados.

Otro rasgo decisivo es que la informática ha dejado de ser asunto exclusivo de especialistas. Aunque su desarrollo profundo requiere profesionales cualificados, su uso afecta a casi todas las personas. Trabajar, estudiar, comprar, comunicarse, pedir una cita médica, consultar una nómina, guardar fotografías o gestionar documentos son acciones cada vez más mediadas por sistemas digitales. Esto convierte la cultura informática en una parte básica de la formación contemporánea, igual que saber leer, escribir o manejar información elemental.

La informática es grande no solo por sus máquinas, sino por el tipo de mundo que ha contribuido a crear. Ha convertido la información en una materia activa, capaz de circular, transformarse y organizar procesos enteros. Ha hecho posible una sociedad más conectada, más rápida y más dependiente de sus infraestructuras digitales. Comprenderla no significa admirarla sin reservas, sino reconocer su papel central en nuestro tiempo. Es una disciplina técnica, pero también histórica y cultural: una de las claves para entender cómo funciona la vida contemporánea.

1.5. Diferencia entre informática, computación, tecnología digital e Internet

Informática, computación, tecnología digital e Internet son términos muy relacionados, pero no significan exactamente lo mismo. En el lenguaje cotidiano suelen mezclarse, porque todos forman parte del mismo universo técnico. Sin embargo, distinguirlos ayuda a entender mejor cómo está organizado el mundo digital. No es una cuestión de palabras complicadas, sino de precisión conceptual. Cada término señala una parte distinta de una realidad más amplia: la ciencia que estudia la información, los procesos de cálculo que ejecutan las máquinas, los dispositivos que trabajan con datos digitales y la gran red que conecta millones de sistemas en todo el planeta.

La informática es el campo general. Estudia el tratamiento automático de la información: cómo se representa, cómo se procesa, cómo se almacena, cómo se transmite y cómo se utiliza mediante sistemas técnicos. Su objeto central no es solo el ordenador, sino la información convertida en algo operativo. Por eso la informática incluye muchas áreas: programación, bases de datos, sistemas operativos, redes, seguridad, inteligencia artificial, diseño de software, organización de archivos, interacción con el usuario y aplicaciones en empresas, ciencia, cultura o administración. Es una disciplina amplia, con fundamentos teóricos y aplicaciones prácticas.

La computación, en cambio, se refiere de manera más concreta al cálculo y al proceso mediante el cual una máquina ejecuta instrucciones. Tiene una raíz más ligada a los algoritmos, a la lógica formal y a la capacidad de resolver problemas paso a paso. Cuando hablamos de computación pensamos en operaciones, procedimientos, modelos, programas y procesos que transforman una entrada en una salida. Un ordenador computa cuando realiza cálculos, compara datos, ejecuta instrucciones o sigue un algoritmo. La computación es, por tanto, una parte esencial de la informática, pero no agota todo su significado.

La tecnología digital es un concepto todavía más amplio desde el punto de vista material y social. Se refiere al conjunto de dispositivos, sistemas y servicios que utilizan información representada digitalmente, normalmente mediante ceros y unos. Incluye ordenadores, teléfonos móviles, cámaras, tabletas, sensores, pantallas, servidores, plataformas, programas y redes. Un reloj inteligente, una cámara digital, una tarjeta bancaria, un navegador GPS o una televisión conectada forman parte de la tecnología digital. Aquí el foco no está tanto en la disciplina que estudia la información, sino en los objetos y sistemas que la utilizan en la vida real.

Internet, por su parte, es una red mundial de redes. Su función principal es conectar dispositivos y sistemas para que puedan intercambiar información. No es sinónimo de informática, aunque dependa completamente de ella. Tampoco es lo mismo que la tecnología digital, aunque sea una de sus expresiones más importantes. Internet permite enviar correos, consultar páginas web, usar redes sociales, ver vídeos, acceder a servicios en la nube o comunicarse en tiempo real. Pero todo eso ocurre porque debajo existen ordenadores, servidores, protocolos, cables, centros de datos, programas y reglas de transmisión.

Una comparación sencilla puede aclararlo. La informática sería el campo de conocimiento que estudia cómo tratar información mediante sistemas automáticos. La computación sería el conjunto de procesos lógicos y algoritmos que permiten a esos sistemas trabajar. La tecnología digital sería el conjunto de aparatos y servicios que hacen visible esa capacidad en la vida cotidiana. Internet sería la gran infraestructura de conexión que permite que muchos de esos sistemas se comuniquen entre sí. Son niveles distintos de una misma realidad.

Esta distinción es importante porque evita confundir el uso de Internet con el conjunto de la informática. Una persona puede usar Internet todos los días sin comprender demasiado cómo funciona un ordenador, qué es un sistema operativo, cómo se almacenan los datos o qué hace un programa. Del mismo modo, puede existir informática sin conexión a Internet: un ordenador puede procesar textos, editar imágenes, calcular datos o ejecutar programas aunque esté completamente desconectado. Internet amplía enormemente las posibilidades de la informática, pero no la define por completo.

Comprender estas diferencias permite mirar el mundo digital con más claridad. La informática es la base conceptual y técnica; la computación es el motor lógico; la tecnología digital es el conjunto de herramientas concretas; Internet es la red que conecta una parte enorme de esas herramientas. Separar estos términos no los aleja, sino que ayuda a ver cómo encajan. En una época en la que casi todo parece “estar en Internet”, conviene recordar que detrás de cada pantalla hay una arquitectura mucho más profunda: información, cálculo, máquinas, programas y redes trabajando juntas.

2. El concepto de información

2.1. Qué es la información.

2.2. Información, datos y conocimiento.

2.3. La codificación de la información.

2.4. Del lenguaje humano al lenguaje de las máquinas.

2.5. La importancia de medir, almacenar y transmitir información.

La informática solo puede comprenderse bien si antes se entiende qué es la información. Todo sistema digital trabaja con ella, aunque no siempre la veamos de forma directa. La información puede aparecer como una palabra escrita, una imagen, una señal eléctrica, una cifra, una coordenada, una temperatura, un sonido grabado o una instrucción dentro de un programa. En todos los casos, lo importante es que contiene algún tipo de significado o valor útil para interpretar, decidir, recordar o actuar. La informática no trata con la realidad completa, sino con representaciones de la realidad convertidas en datos manejables por una máquina.

Este capítulo se centra en esa idea básica. Antes de hablar de ordenadores, procesadores, software o redes, conviene detenerse en la materia invisible que todos ellos procesan. La información no es simplemente una acumulación de datos. Un dato puede ser una cifra aislada, una palabra suelta o un registro sin contexto. La información surge cuando esos datos se organizan de manera que permiten comprender algo. Y el conocimiento aparece cuando esa información se interpreta, se relaciona con otras ideas y se utiliza con criterio. Esta diferencia es esencial en el mundo digital, donde abundan los datos, pero no siempre existe verdadera comprensión.

También será necesario explicar cómo la información se codifica. Para que una máquina pueda trabajar con un texto, una imagen o un sonido, primero debe convertirlos a un formato que pueda reconocer. El ordenador no entiende las palabras como una persona, ni contempla una fotografía como un ojo humano. Necesita traducirlo todo a señales, números y códigos. Esa traducción permite que la información pueda almacenarse, copiarse, modificarse y transmitirse. La codificación es, por tanto, una operación fundamental: convierte el lenguaje humano y la experiencia sensible en estructuras técnicas que los sistemas digitales pueden procesar.

A partir de ahí se entiende mejor el paso del lenguaje humano al lenguaje de las máquinas. Las personas hablamos mediante palabras, gestos, imágenes, símbolos y contextos. Las máquinas trabajan con instrucciones precisas, valores definidos y reglas formales. La informática crea puentes entre ambos mundos. Un teclado, una pantalla, un programa de edición, una página web o una aplicación móvil permiten que una persona interactúe con sistemas muy complejos sin tener que conocer todos sus detalles internos. La interfaz simplifica la relación, pero debajo sigue existiendo una traducción constante entre significados humanos y operaciones técnicas.

El capítulo también aborda la importancia de medir, almacenar y transmitir información. Medir permite convertir aspectos del mundo en datos: una distancia, una temperatura, una velocidad, una posición, una cantidad económica. Almacenar permite conservar esos datos para usarlos después. Transmitir permite que circulen entre personas, máquinas y lugares distintos. Estas tres acciones sostienen gran parte del mundo digital. Una base de datos médica, un archivo fotográfico, una transferencia bancaria, una videollamada o una consulta en Internet dependen de que la información pueda registrarse, guardarse y moverse con fiabilidad.

Comprender el concepto de información ayuda a mirar la informática con más claridad. La pantalla muestra resultados visibles, pero el verdadero trabajo ocurre en una capa menos evidente: datos que se codifican, se ordenan, se comparan, se transforman y se comunican. El mundo digital no es una realidad separada del mundo físico, sino una forma de representar partes de ese mundo mediante información estructurada. Por eso este capítulo funciona como una base conceptual del resto del artículo. Si la informática es la ciencia del tratamiento automático de la información, entender qué significa “información” es el primer paso para comprender cómo funcionan los sistemas digitales y por qué han llegado a ser tan importantes en la vida contemporánea.

2.1. Qué es la información

La información es aquello que permite conocer algo sobre la realidad, reducir una incertidumbre o dar sentido a un conjunto de señales. Puede aparecer en formas muy distintas: una palabra, una cifra, una imagen, una señal acústica, una temperatura, una dirección, una fecha, una noticia o una instrucción. Lo importante no es solo su apariencia, sino su capacidad para transmitir algún contenido útil. Cuando alguien lee un cartel que indica una salida, escucha una alarma, consulta el saldo de una cuenta o mira el icono de batería de un teléfono, está recibiendo información que le ayuda a interpretar una situación y actuar en consecuencia.

En términos sencillos, la información es una representación significativa de algo. No es la realidad completa, sino una forma de seleccionarla, ordenarla y comunicarla. Un mapa no es el territorio, pero ofrece información sobre él. Una fotografía no es la persona retratada, pero conserva ciertos rasgos visuales. Un historial médico no es el cuerpo del paciente, pero reúne datos importantes sobre su salud. Esta distancia entre realidad e información es esencial: todo sistema informativo simplifica el mundo para hacerlo manejable. Gracias a esa simplificación podemos recordar, clasificar, comparar, calcular y tomar decisiones.

La información necesita algún tipo de soporte. Puede estar escrita en papel, grabada en piedra, almacenada en un disco duro, transmitida por ondas de radio o representada en una pantalla. También puede existir como señal: el humo que anuncia fuego, una luz roja en un semáforo, el sonido de una sirena o el movimiento de una aguja en un instrumento de medida. En todos estos casos hay una relación entre una señal y un significado. La señal por sí sola no basta: debe poder interpretarse. Una luz intermitente puede ser inútil si nadie sabe qué indica, mientras que una señal bien comprendida puede organizar el tráfico, advertir de un peligro o guiar una acción.

En informática, la información adquiere una forma especialmente precisa, porque debe ser convertida en datos que una máquina pueda procesar. El ordenador no trabaja con significados humanos de manera directa. No “entiende” una carta, una imagen o una canción como lo hace una persona. Lo que maneja son representaciones codificadas: números, bits, caracteres, valores, instrucciones y estructuras. La informática transforma información en datos operables, es decir, en unidades que pueden almacenarse, ordenarse, compararse, modificarse y transmitirse siguiendo reglas.

Esto explica por qué la información es la base del mundo digital. Un mensaje de texto, una página web, una fotografía, un vídeo, un archivo musical o una hoja de cálculo son contenidos diferentes para nosotros, pero todos pueden ser tratados por la máquina como datos codificados. La diversidad visible se apoya en una misma lógica interna: representar algo mediante signos que el sistema puede manejar. Esa capacidad de conversión hace posible que los contenidos circulen entre dispositivos, se copien, se editen y se recuperen con enorme rapidez.

Sin embargo, la información no debe confundirse con conocimiento. Tener información significa disponer de datos con significado; conocer implica interpretarlos correctamente, relacionarlos con un contexto y usarlos con criterio. Una persona puede recibir miles de noticias, cifras o mensajes sin comprender realmente lo que ocurre. Esta diferencia es muy importante en la sociedad digital, donde la abundancia informativa no siempre produce claridad. La informática facilita el acceso y el procesamiento de información, pero no sustituye por completo la comprensión humana.

Por tanto, la información puede entenderse como el material simbólico con el que interpretamos y organizamos el mundo. Permite registrar hechos, comunicar ideas, coordinar acciones y conservar memoria. En el ámbito informático, esa información se convierte en una materia técnica: algo que puede codificarse, almacenarse y procesarse automáticamente. Comprender qué es la información ayuda a entender por qué la informática es tan poderosa. No trabaja solo con máquinas, sino con una dimensión central de la vida humana: nuestra necesidad de saber, recordar, comunicar y dar sentido a la realidad.

2.2. Información, datos y conocimiento

Datos, información y conocimiento son conceptos cercanos, pero no equivalentes. Distinguirlos es fundamental para comprender cómo funciona la informática y, en general, cómo se organiza el mundo digital. Un dato es una unidad básica de registro: una cifra, una palabra, una fecha, una coordenada, una temperatura, un nombre, un precio o una medida. Por sí solo puede tener poco sentido. “37”, por ejemplo, es solo un número. Puede referirse a una edad, una temperatura corporal, una talla de zapato, una cantidad económica o una posición en una lista. El dato necesita contexto para convertirse en algo verdaderamente útil.

La información aparece cuando los datos se ordenan y adquieren significado. Si decimos “37 grados de temperatura corporal”, el número ya no está aislado: nos informa sobre el estado de una persona. Si añadimos que esa temperatura pertenece a un paciente, que fue tomada por la mañana y que ha bajado respecto al día anterior, el dato se vuelve todavía más claro. La información, por tanto, no es una simple acumulación de datos, sino datos interpretables dentro de un marco. En informática, gran parte del trabajo consiste precisamente en recoger datos, organizarlos y presentarlos de manera que puedan ser comprendidos.

El conocimiento va un paso más allá. Surge cuando la información se interpreta, se relaciona con experiencias previas y permite comprender una situación o tomar decisiones. Saber que un paciente tiene 37 grados no basta por sí solo; el conocimiento médico permite valorar si esa cifra es normal, preocupante o irrelevante según la edad, los síntomas, el contexto y la evolución. Lo mismo ocurre en una empresa, en una investigación científica o en una administración pública. Los datos ofrecen registros; la información los ordena; el conocimiento permite actuar con criterio.

Esta diferencia es especialmente importante en la sociedad actual, porque vivimos rodeados de datos. Cada búsqueda en Internet, cada compra electrónica, cada fotografía subida a una nube, cada ubicación registrada por un móvil o cada interacción en una red social genera datos. Los sistemas informáticos pueden almacenarlos y procesarlos en grandes cantidades, pero eso no significa que por sí mismos produzcan comprensión. Una base de datos inmensa puede ser inútil si está mal organizada, si contiene errores o si nadie sabe interpretarla. La abundancia de datos no garantiza inteligencia.

En este punto, la informática muestra tanto su poder como sus límites. Su poder consiste en manejar volúmenes de información imposibles para una persona: ordenar millones de registros, detectar patrones, cruzar variables, localizar documentos, calcular tendencias o automatizar tareas. Sus límites aparecen cuando se confunde el procesamiento técnico con la comprensión humana. Un sistema puede clasificar información con enorme rapidez, pero el sentido final de esa información depende de preguntas, criterios, valores y objetivos que no son puramente mecánicos.

Un ejemplo cotidiano puede verse en un buscador de Internet. El sistema localiza páginas, compara palabras, ordena resultados y ofrece enlaces. Eso es un trabajo informático extraordinario. Pero el usuario debe valorar si la fuente es fiable, si el contenido está actualizado, si responde realmente a lo que busca y si encaja con otros conocimientos. El buscador facilita el acceso a la información, pero no sustituye el juicio personal. La máquina ayuda a encontrar; la persona debe comprender.

Por eso es útil pensar en una especie de escala. El dato es el elemento mínimo; la información es el dato con sentido; el conocimiento es la información comprendida e integrada. Esta escala no siempre es rígida, pero ayuda a evitar confusiones. En el mundo digital, muchas veces se habla de “conocimiento” cuando en realidad solo hay acumulación de datos, o se habla de “información” cuando apenas hay señales dispersas. La informática permite transformar datos en información organizada, pero el paso hacia el conocimiento exige interpretación.

Comprender esta diferencia ayuda a usar mejor la tecnología. No basta con tener acceso a archivos, estadísticas, páginas web o plataformas digitales. Lo decisivo es saber qué significan, cómo se relacionan y para qué sirven. En una época de abundancia informativa, el valor no está solo en acumular datos, sino en convertirlos en comprensión. Ahí se encuentra una de las tareas más importantes del ser humano dentro del mundo digital: no quedar enterrado bajo la información, sino aprender a darle forma, sentido y orientación.

2.3. La codificación de la información

La codificación de la información es el proceso mediante el cual un contenido se transforma en un sistema de signos que puede ser almacenado, transmitido o procesado. Es una idea sencilla, pero fundamental. Para que una información pueda circular o ser trabajada por una máquina, primero debe adoptar una forma reconocible por ese sistema. Una palabra escrita, una imagen, un sonido o una orden no entran directamente en el ordenador como experiencias humanas completas, sino como datos codificados según unas reglas precisas.

La codificación existe mucho antes de la informática. La escritura es una forma de codificar el lenguaje hablado mediante signos gráficos. Un mapa codifica un territorio mediante líneas, colores y símbolos. Una partitura codifica una pieza musical para que pueda ser interpretada por un músico. Un semáforo codifica órdenes de tráfico mediante luces de colores. En todos estos casos, una realidad compleja se convierte en un conjunto de señales organizadas. La informática continúa esa tradición, pero la lleva a un nivel mucho más abstracto y automático.

En el mundo digital, codificar significa traducir información a una forma que la máquina pueda manejar. Los ordenadores trabajan internamente con señales eléctricas que se representan mediante dos estados básicos, normalmente expresados como ceros y unos. A partir de esa base binaria se construyen todos los demás contenidos. Una letra, una cifra, una fotografía, una canción o un vídeo pueden convertirse en combinaciones de bits. Para el usuario, esos contenidos tienen significado humano; para la máquina, son secuencias organizadas de datos.

Esto no significa que una imagen o una palabra pierdan su valor al codificarse. Significa que se transforman en una representación técnica. Una fotografía digital, por ejemplo, no se guarda como una “imagen” en sentido humano, sino como una estructura de píxeles, colores y valores numéricos. Un texto se almacena mediante códigos que asignan números a cada carácter. Un sonido se convierte en muestras digitales que representan variaciones de una onda. Gracias a esta traducción, el ordenador puede copiar, editar, comprimir, enviar o recuperar esos contenidos.

La codificación también exige acuerdos. Para que un sistema pueda leer correctamente una información, debe conocer las reglas con las que ha sido codificada. Si dos máquinas utilizan sistemas incompatibles, pueden aparecer errores, caracteres extraños, archivos ilegibles o pérdidas de contenido. Por eso existen estándares y formatos: sistemas compartidos que permiten que la información circule entre dispositivos y programas diferentes. Cuando abrimos un archivo de texto, una imagen JPG, un vídeo MP4 o una página web, estamos confiando en reglas de codificación aceptadas por muchos sistemas.

Este proceso tiene una importancia enorme en la vida cotidiana. Cada mensaje enviado por el móvil, cada fotografía guardada, cada documento escrito, cada canción reproducida y cada página consultada en Internet dependen de algún tipo de codificación. Lo que parece inmediato en la pantalla es el resultado de una larga cadena de traducciones invisibles. El usuario escribe, toca, mira o escucha; la máquina convierte esas acciones en señales digitales, las procesa y las devuelve en una forma comprensible para la persona.

Pero la codificación también tiene límites. Toda representación selecciona y simplifica. Un archivo digital no captura la realidad completa, sino una versión de ella ajustada a un formato. Una imagen puede perder calidad si se comprime demasiado; un texto puede mostrar errores si se usa una codificación inadecuada; un sonido puede perder matices según cómo se registre. Por eso la calidad de la codificación influye directamente en la fidelidad, la claridad y la utilidad de la información.

Comprender la codificación ayuda a ver que el mundo digital no es mágico ni inmaterial. Detrás de cada contenido hay reglas, formatos, conversiones y estructuras. La informática convierte la información en algo manipulable porque la traduce a códigos que las máquinas pueden procesar. Esta operación es una de las bases de toda la tecnología digital: permite que lo humano entre en contacto con lo automático, que el lenguaje se convierta en dato y que la experiencia pueda viajar a través de circuitos, memorias y redes.

2.4. Del lenguaje humano al lenguaje de las máquinas

El lenguaje humano y el lenguaje de las máquinas pertenecen a mundos muy distintos. Las personas nos comunicamos con palabras, gestos, imágenes, tonos de voz, silencios, recuerdos y contextos compartidos. Una frase puede tener matices, dobles sentidos, intención emocional o significado cultural. Las máquinas, en cambio, necesitan instrucciones precisas, datos definidos y reglas claras. No interpretan la realidad de forma espontánea, sino que ejecutan operaciones siguiendo estructuras previamente establecidas. Por eso uno de los grandes logros de la informática ha sido crear puentes entre la forma humana de comunicarnos y la forma técnica en que los sistemas digitales procesan información.

Cuando una persona escribe un texto en un ordenador, parece que la máquina comprende las letras. En realidad, cada carácter se transforma en un código numérico que el sistema puede almacenar y mostrar en pantalla. Lo mismo ocurre al pulsar un icono, mover el ratón, grabar un sonido o tomar una fotografía. La acción humana se traduce a datos digitales. Después, el sistema realiza operaciones internas y devuelve un resultado comprensible: una palabra visible, una imagen, una ventana abierta, un archivo guardado o un mensaje enviado. La informática funciona como una cadena continua de traducciones.

Esta traducción es necesaria porque las máquinas no trabajan con significados humanos de manera directa. Un ordenador no sabe qué es una “casa” como la entiende una persona. No recuerda viviendas, familias, calles, olores o experiencias. Lo que puede manejar es una secuencia de caracteres, una imagen asociada, una base de datos o un conjunto de instrucciones relacionadas con esa palabra. La comprensión humana está llena de experiencia; el procesamiento de la máquina está basado en representación y cálculo. Esta diferencia no resta valor a la informática, pero ayuda a entender sus límites.

Los lenguajes de programación son una de las formas más importantes de ese puente. Permiten que una persona escriba instrucciones con una sintaxis comprensible para los programadores y, al mismo tiempo, traducible a operaciones que la máquina puede ejecutar. Entre el lenguaje humano común y el funcionamiento interno del ordenador hay varias capas: código fuente, compiladores o intérpretes, sistema operativo, procesador y señales eléctricas. El usuario final no ve todo eso, pero cada aplicación que utiliza depende de esa arquitectura.

También las interfaces gráficas cumplen un papel decisivo. Gracias a ventanas, menús, botones, iconos y pantallas táctiles, las personas pueden manejar sistemas muy complejos sin escribir órdenes técnicas. Un icono de papelera, una lupa de búsqueda o una carpeta digital son metáforas visuales. No son objetos físicos reales, pero ayudan al usuario a entender qué acción puede realizar. La informática moderna no solo ha avanzado por aumentar la potencia de cálculo, sino también por hacer más humana la relación con la máquina.

Este paso del lenguaje humano al lenguaje técnico explica buena parte del éxito de la informática. Cuanto más fácil resulta expresar una intención humana en términos que la máquina pueda procesar, más útil se vuelve el sistema. Escribir un documento, editar una fotografía, buscar información, realizar una videollamada o diseñar una página web son acciones que esconden procesos internos muy complejos. El usuario trabaja con formas familiares; la máquina opera con códigos, instrucciones y datos.

Sin embargo, esta traducción nunca es perfecta. El lenguaje humano es ambiguo, abierto y lleno de contexto. Las máquinas necesitan reducir esa riqueza a estructuras más controladas. Incluso los sistemas de inteligencia artificial más avanzados trabajan mediante modelos, patrones y cálculos, no mediante una experiencia humana completa del mundo. Por eso sigue siendo necesario el criterio de la persona: para formular bien las instrucciones, interpretar los resultados y corregir errores cuando la máquina responde de forma limitada o equivocada.

La informática puede entenderse, así, como un gran esfuerzo de mediación entre dos lenguajes. De un lado está el mundo humano, con sus necesidades, ideas y formas de expresión. Del otro, el mundo de la máquina, basado en datos, códigos e instrucciones. Entre ambos se sitúan los programas, las interfaces, los lenguajes de programación y los sistemas digitales. Gracias a ellos, una intención humana puede convertirse en una operación técnica y volver de nuevo como resultado útil. Esa ida y vuelta es una de las bases del mundo digital contemporáneo.

2.5. La importancia de medir, almacenar y transmitir información

Medir, almacenar y transmitir información son tres acciones básicas para comprender el funcionamiento del mundo digital. La informática no trabaja con la realidad de manera directa, sino con datos obtenidos de ella. Para que una máquina pueda procesar algo, primero debe existir algún tipo de registro: una cantidad, una señal, una palabra, una imagen, una posición, una temperatura, una fecha o una instrucción. Medir significa convertir una parte del mundo en un dato manejable. Es el primer paso para que la información pueda entrar en un sistema informático.

Medimos constantemente, aunque muchas veces no lo pensemos. Un termómetro convierte el calor corporal en una cifra; un reloj transforma el paso del tiempo en unidades; un sensor de un coche registra velocidad, distancia o presión; una cámara convierte luz en imagen digital; un móvil registra ubicación, batería, movimiento o conexión. Gracias a esas mediciones, el mundo físico puede representarse en forma de datos. Sin esa traducción, la informática no podría intervenir en tantos aspectos de la vida cotidiana, la ciencia, la industria o la administración.

Almacenar información es conservar esos datos para que puedan ser utilizados después. Esta capacidad ha sido una de las grandes aspiraciones humanas desde la escritura. Guardar información permite recordar, comparar, estudiar, administrar y planificar. En el mundo digital, el almacenamiento ha alcanzado una escala enorme. Documentos, fotografías, vídeos, historiales médicos, bases de datos empresariales, archivos científicos, correos electrónicos y páginas web pueden conservarse en discos duros, memorias, servidores o servicios en la nube. La memoria digital amplía la memoria humana, aunque también la vuelve dependiente de sistemas técnicos.

La transmisión de información completa este proceso. No basta con medir y guardar: la información debe poder circular. Un dato médico puede viajar de un laboratorio a un hospital; un mensaje puede llegar en segundos a otro país; una imagen puede enviarse desde un teléfono a un servidor; una página web puede consultarse desde cualquier lugar conectado. Esta capacidad de transmisión ha cambiado radicalmente la comunicación humana. La información ya no queda encerrada en un soporte físico local, sino que puede desplazarse por redes, cables, antenas y sistemas distribuidos.

Estas tres acciones están profundamente relacionadas. Una medición sin almacenamiento puede perderse. Un archivo almacenado pero incomunicado queda aislado. Una transmisión sin datos fiables puede difundir errores. La calidad del mundo digital depende de que la información se mida con precisión, se conserve con seguridad y se transmita de manera fiable. Por eso la informática no solo busca rapidez, sino también exactitud, organización y control. Un error pequeño en una medición, una pérdida de datos o una transmisión defectuosa pueden tener consecuencias importantes en un banco, un hospital, una empresa o un sistema de transporte.

También conviene recordar que medir, almacenar y transmitir información implica responsabilidad. No todos los datos deben recogerse sin límite, ni toda información debe circular sin protección. Los datos personales, médicos, financieros o administrativos requieren cuidado. La capacidad técnica de registrar información no significa que siempre sea legítimo hacerlo. Aquí aparecen cuestiones esenciales como la privacidad, la seguridad, el consentimiento y el uso correcto de los datos. El mundo digital ofrece enormes posibilidades, pero también obliga a pensar qué información se guarda, quién puede acceder a ella y con qué finalidad se utiliza.

En la vida cotidiana, estas operaciones están presentes en gestos muy simples. Al guardar una fotografía, enviar un mensaje, consultar una cuenta bancaria, usar un mapa digital o hacer una copia de seguridad, estamos participando en ese ciclo de medición, almacenamiento y transmisión. El usuario solo ve la acción inmediata, pero debajo actúan sensores, archivos, protocolos, servidores y sistemas de protección.

La informática moderna se sostiene sobre esta circulación organizada de información. Medir permite convertir la realidad en dato; almacenar permite conservarlo; transmitir permite compartirlo y hacerlo útil a distancia. Gracias a estas tres capacidades, la información se convierte en una fuerza activa: puede recordar el pasado, orientar decisiones presentes y coordinar acciones futuras. Ahí se encuentra una de las grandes claves del mundo digital: no solo produce máquinas más rápidas, sino sistemas capaces de registrar, guardar y mover información a una escala nunca antes vista.

3. Los orígenes históricos del cálculo y la computación

3.1. El cálculo antes de los ordenadores.

3.2. Ábacos, tablas, reglas de cálculo y máquinas mecánicas.

3.3. Blaise Pascal, Leibniz y las primeras máquinas calculadoras.

3.4. Charles Babbage y la idea de una máquina programable.

3.5. Ada Lovelace y el nacimiento conceptual de la programación.

3.6. La lógica matemática como base de la computación moderna.

La informática moderna no nació de repente con los ordenadores electrónicos del siglo XX. Sus raíces son mucho más antiguas y se encuentran en una necesidad humana básica: contar, medir, registrar y calcular. Antes de que existieran los circuitos, los procesadores o los lenguajes de programación, las sociedades ya necesitaban llevar cuentas, repartir cosechas, medir terrenos, calcular impuestos, planificar obras, navegar, comerciar y observar los astros. El cálculo fue, desde muy pronto, una herramienta de organización práctica, pero también una forma de ordenar el mundo.

Este capítulo se centra en ese largo camino que va desde los instrumentos sencillos de cálculo hasta la idea de una máquina capaz de ejecutar operaciones de manera automática. El ábaco, las tablas numéricas, las reglas de cálculo y las primeras máquinas mecánicas muestran que el ser humano intentó descargar parte del esfuerzo mental en herramientas externas. No eran ordenadores en sentido moderno, pero sí anticipaban una idea fundamental: convertir operaciones repetitivas en procedimientos apoyados por instrumentos. Cada avance permitía calcular con más rapidez, reducir errores y hacer manejables problemas cada vez más complejos.

En la Edad Moderna, figuras como Blaise Pascal y Gottfried Wilhelm Leibniz dieron un paso decisivo al diseñar máquinas calculadoras mecánicas. Estas máquinas podían realizar operaciones aritméticas mediante engranajes y mecanismos físicos. Su importancia no reside solo en lo que podían calcular, sino en la idea que representaban: una operación intelectual podía traducirse a movimiento mecánico. El cálculo dejaba de ser exclusivamente una actividad mental o manual y empezaba a convertirse en un proceso automatizable. Esa intuición será esencial para el desarrollo posterior de la computación.

El gran salto conceptual llegó con Charles Babbage, que imaginó una máquina mucho más ambiciosa: no solo una calculadora, sino un dispositivo programable capaz de realizar distintas operaciones siguiendo instrucciones. Aunque sus proyectos no llegaron a completarse plenamente en su tiempo, la idea de una máquina general, capaz de ejecutar procedimientos diversos, anticipaba el ordenador moderno. Babbage no solo pensó en calcular más rápido; pensó en construir una arquitectura para procesar información de forma sistemática.

Junto a él aparece Ada Lovelace, una figura clave porque comprendió que una máquina de este tipo podía ir más allá del cálculo numérico. Su visión apuntaba a que, si los símbolos podían representarse y manipularse según reglas, entonces la máquina podría trabajar no solo con números, sino también con otros tipos de información. Esa intuición permite verla como una de las primeras personas en formular conceptualmente la programación. La máquina no sería solo un aparato de cálculo, sino un sistema capaz de seguir instrucciones para producir resultados.

El capítulo se cerrará con la lógica matemática, base teórica de la computación moderna. A medida que las matemáticas y la lógica buscaron formalizar el razonamiento, se hizo posible pensar en procedimientos exactos, reglas simbólicas y métodos generales para resolver problemas. La computación moderna nacerá precisamente de esa unión entre cálculo, lógica y automatización. Antes de que existiera el ordenador físico, fue necesario imaginar que el pensamiento podía expresarse en pasos claros, finitos y ejecutables.

Comprender estos orígenes históricos permite ver la informática como el resultado de una evolución larga. No empieza en una pantalla ni en un microchip, sino en el deseo humano de calcular mejor, ordenar datos y convertir procedimientos mentales en sistemas repetibles. Los ordenadores modernos son herederos de ábacos, tablas, engranajes, máquinas calculadoras, proyectos visionarios y teorías lógicas. La informática aparece así no como una ruptura absoluta con el pasado, sino como la culminación técnica de una vieja aspiración: construir herramientas capaces de ayudar a la mente humana a procesar el mundo con mayor precisión, rapidez y alcance.

3.1. El cálculo antes de los ordenadores

Antes de que existieran los ordenadores, el cálculo ya era una necesidad esencial de la vida humana. Contar animales, medir cosechas, repartir alimentos, calcular impuestos, levantar edificios, comerciar, navegar o estudiar los astros exigía algún tipo de operación numérica. La humanidad no empezó a calcular por curiosidad abstracta, sino por necesidades muy concretas: organizar recursos, prever cantidades, comparar valores y tomar decisiones. El cálculo nació unido a la vida práctica, mucho antes de convertirse en una disciplina formal.

Las primeras sociedades agrícolas y urbanas necesitaron contar y registrar. Cuando una comunidad produce grano, almacena aceite, intercambia ganado o cobra tributos, necesita saber cuánto tiene, cuánto debe y cuánto puede repartir. La aparición de la escritura y de los sistemas numéricos estuvo muy ligada a esa necesidad de administración. En Mesopotamia, Egipto y otras civilizaciones antiguas, los números no eran solo una herramienta matemática, sino una forma de organizar la economía, la propiedad, el trabajo y el poder político. Calcular era una manera de gobernar mejor la realidad.

Durante mucho tiempo, el cálculo dependió del cuerpo, de la memoria y de objetos sencillos. Los dedos sirvieron como primer instrumento natural para contar. Piedras, marcas, nudos, tablillas o fichas permitieron conservar cantidades y hacer operaciones simples. Estos recursos pueden parecer rudimentarios, pero tienen una importancia profunda: muestran que el ser humano aprendió pronto a representar cantidades mediante signos externos. Al hacerlo, empezó a separar el pensamiento del instante inmediato y a apoyarlo en instrumentos visibles.

El cálculo también fue imprescindible para la arquitectura, la ingeniería y la astronomía. Construir un templo, trazar un canal, medir un campo o calcular un calendario exigía relaciones numéricas. Las civilizaciones antiguas desarrollaron métodos para medir superficies, estimar volúmenes, prever estaciones y ordenar el tiempo. La observación del cielo, por ejemplo, requería registrar ciclos y comparar posiciones. Aunque estos métodos no fueran “informáticos” en sentido moderno, ya contenían una idea básica: la realidad podía describirse y organizarse mediante números.

En el comercio, el cálculo tuvo un papel igualmente decisivo. Comprar, vender, pesar mercancías, convertir unidades, fijar precios o calcular deudas exigía rapidez y fiabilidad. Las operaciones repetitivas podían provocar errores, y esos errores podían tener consecuencias económicas. Por eso surgieron instrumentos y técnicas destinados a facilitar las cuentas. La necesidad de calcular mejor no fue un lujo intelectual, sino una exigencia de sociedades cada vez más complejas.

Este desarrollo histórico permite entender algo importante: el ordenador no inventó el cálculo, sino que lo automatizó a una escala nueva. Antes de las máquinas electrónicas, ya existía una larga tradición de procedimientos, instrumentos y métodos para trabajar con cantidades. Lo que cambiará con la computación moderna será la velocidad, la precisión, la capacidad de repetición y el volumen de operaciones posibles. Pero la raíz cultural es anterior: contar, medir y ordenar han sido siempre formas de reducir la incertidumbre.

También conviene recordar que el cálculo no se limita a hacer cuentas. Calcular es establecer relaciones, seguir reglas, comparar resultados y llegar a una conclusión mediante pasos ordenados. En ese sentido, el cálculo antiguo anticipa una parte de la lógica informática. Cuando una persona aplica un procedimiento para resolver un problema numérico, está siguiendo una secuencia de operaciones. Esa idea de procedimiento será fundamental para entender los algoritmos y, más adelante, la programación.

El cálculo antes de los ordenadores fue, por tanto, una larga preparación histórica. Desde los dedos y las marcas hasta las tablas numéricas y los instrumentos mecánicos, la humanidad fue creando ayudas para ampliar su capacidad mental. Cada avance permitió manejar mejor cantidades, registrar información y resolver problemas prácticos. La informática moderna heredará esa tradición y la llevará mucho más lejos, pero su origen remoto está en una necesidad muy antigua: convertir el mundo en algo contable, medible y comprensible.

3.2. Ábacos, tablas, reglas de cálculo y máquinas mecánicas

Antes de los ordenadores electrónicos, la humanidad desarrolló numerosos instrumentos para facilitar el cálculo. No eran máquinas inteligentes ni sistemas digitales, pero cumplían una función decisiva: ayudaban a realizar operaciones de manera más rápida, ordenada y fiable. El cálculo manual, apoyado solo en la memoria y en la escritura, podía ser lento y propenso a errores. Por eso, desde épocas muy antiguas, se buscaron herramientas capaces de representar cantidades, conservar resultados parciales y simplificar operaciones repetitivas.

El ábaco es uno de los ejemplos más antiguos y eficaces. Su principio es sencillo: representar números mediante cuentas o piezas móviles colocadas en distintas posiciones. Cada columna o fila tiene un valor, y al desplazar las piezas se pueden hacer sumas, restas, multiplicaciones o divisiones. Su importancia no está solo en la herramienta material, sino en la idea que contiene: el número se convierte en una disposición física manipulable. El cálculo deja de depender únicamente de la mente y pasa a apoyarse en un sistema externo de representación.

Las tablas numéricas fueron otro avance fundamental. Una tabla permite reunir resultados ya calculados para no tener que repetir siempre las mismas operaciones. Tablas de multiplicar, tablas astronómicas, tablas trigonométricas o tablas de navegación ayudaron durante siglos a comerciantes, arquitectos, ingenieros, astrónomos y navegantes. Su utilidad era enorme, porque convertían cálculos difíciles en consultas organizadas. En cierto modo, una tabla es una memoria matemática preparada de antemano: guarda relaciones numéricas para que puedan usarse cuando sea necesario.

Más adelante aparecieron instrumentos como la regla de cálculo, muy utilizada antes de la llegada de las calculadoras electrónicas. Basada en principios matemáticos como los logaritmos, permitía realizar multiplicaciones, divisiones y otras operaciones mediante escalas deslizantes. No daba resultados con la exactitud absoluta de una calculadora moderna, pero ofrecía rapidez suficiente para muchas tareas técnicas. Ingenieros, físicos y arquitectos la utilizaron durante generaciones. Fue una herramienta práctica en una época en la que calcular con agilidad podía marcar la diferencia en el trabajo científico e industrial.

Las máquinas mecánicas añadieron un nuevo elemento: el movimiento automático de piezas. Engranajes, ruedas dentadas, palancas y mecanismos podían representar números y ejecutar operaciones. Estas máquinas trasladaban el cálculo al terreno de la mecánica. Cuando una rueda avanzaba una posición, otra podía moverse en consecuencia, reproduciendo de forma física el arrastre de una suma o el desarrollo de una operación. El pensamiento numérico se convertía en movimiento ordenado.

Estos instrumentos muestran una evolución muy importante. El ser humano no solo buscaba calcular, sino construir ayudas cada vez más precisas para descargar tareas repetitivas. El ábaco organizaba cantidades; las tablas conservaban resultados; la regla de cálculo aceleraba operaciones; las máquinas mecánicas empezaban a automatizar procesos. Cada uno de estos pasos anticipaba, de algún modo, la lógica posterior de la computación: representar información, aplicar reglas y obtener resultados mediante un sistema externo.

También revelan que la historia de la informática no comienza con la electricidad, sino con la necesidad de mecanizar el razonamiento práctico. Mucho antes de los microchips, ya existía el deseo de convertir operaciones mentales en procedimientos materiales. La diferencia es que esos sistemas antiguos estaban limitados por su soporte físico. Dependían de la habilidad del usuario, de la precisión de las piezas o de la calidad de las tablas. Aun así, fueron esenciales para preparar el camino.

El ordenador moderno heredará esa tradición y la transformará radicalmente. Ya no moverá cuentas o engranajes visibles, sino señales eléctricas y datos digitales. Pero la idea de fondo seguirá siendo parecida: ayudar a la mente humana a procesar información con mayor rapidez y menor error. Ábacos, tablas, reglas de cálculo y máquinas mecánicas forman parte de esa genealogía. Son los antepasados técnicos de una aspiración antigua: convertir el cálculo en un proceso ordenado, repetible y cada vez más automático.

3.3. Blaise Pascal, Leibniz y las primeras máquinas calculadoras

Las primeras máquinas calculadoras de la Edad Moderna representan un paso decisivo en la historia de la computación, porque llevaron el cálculo más allá del instrumento auxiliar y lo acercaron a la automatización mecánica. Hasta entonces, herramientas como el ábaco o las tablas ayudaban a calcular, pero exigían una intervención constante del usuario. Con las máquinas de Blaise Pascal y Gottfried Wilhelm Leibniz aparece una idea más ambiciosa: construir dispositivos capaces de realizar operaciones aritméticas mediante engranajes, ruedas y mecanismos internos.

Blaise Pascal diseñó en el siglo XVII una máquina conocida como la Pascalina. Su objetivo era práctico: ayudar a su padre, que trabajaba en tareas administrativas y fiscales, a realizar sumas y restas con mayor rapidez y menos errores. La máquina utilizaba ruedas dentadas que avanzaban de forma coordinada. Cuando una rueda completaba una vuelta, arrastraba a la siguiente, de manera parecida a cómo en una suma manual se lleva una unidad a la columna superior. Este detalle es muy importante, porque muestra cómo una operación mental podía traducirse a movimiento físico.

La Pascalina no era un ordenador, ni podía programarse en sentido moderno, pero contenía una intuición fundamental: parte del trabajo intelectual podía incorporarse a una máquina. El cálculo dejaba de depender únicamente de la memoria, la escritura y la habilidad manual. Una estructura mecánica podía seguir reglas numéricas y producir resultados. Era una forma inicial de automatizar una operación lógica, aunque limitada a funciones concretas.

Leibniz fue todavía más lejos. También en el siglo XVII, diseñó una máquina calculadora capaz de realizar no solo sumas y restas, sino también multiplicaciones y divisiones. Su dispositivo utilizaba un mecanismo conocido como cilindro escalonado, que permitía repetir operaciones de forma más sistemática. Leibniz comprendió que la multiplicación podía entenderse como una suma repetida y que, si una máquina era capaz de repetir pasos ordenados, podía resolver operaciones más complejas. Esta manera de pensar anticipa una idea central de la computación: descomponer un problema en operaciones más simples.

La importancia de Pascal y Leibniz no está solo en sus máquinas, sino en el cambio de mentalidad que representan. Ambos mostraron que el cálculo podía mecanizarse. Es decir, que una actividad aparentemente propia de la inteligencia humana podía expresarse mediante reglas materiales. Esta idea abrió el camino a una larga tradición de máquinas calculadoras, primero mecánicas, después electromecánicas y finalmente electrónicas. Cada generación perfeccionaría la anterior, aumentando la velocidad, la precisión y la variedad de operaciones posibles.